以下是当前具有代表性的开源多模态大模型及其核心特点的梳理,结合最新技术动态与应用场景:

一、核心开源多模态模型

-

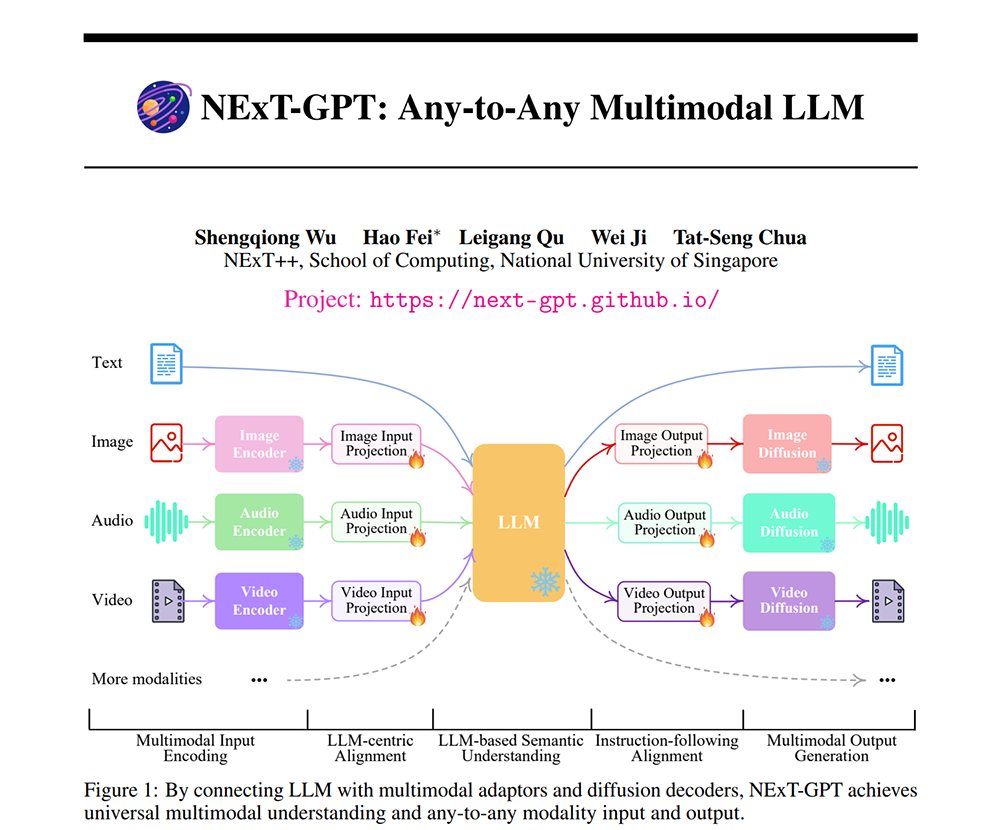

NExT-GPT

支持任意模态输入与输出(文本/图像/音频/视频),通过轻量化参数调优实现跨模态生成,适用于自动图文创作、多模态问答等场景。

-

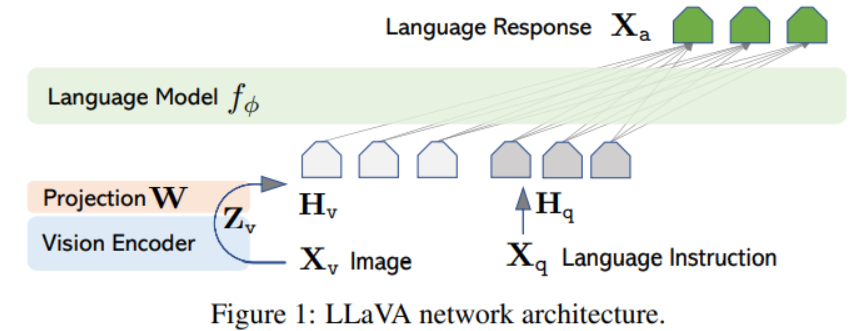

LLaVA

集成Vicuna语言模型与CLIP视觉技术,擅长视觉对话与指令理解,在11个基准测试中刷新SOTA记录,GitHub获6k+星标。

-

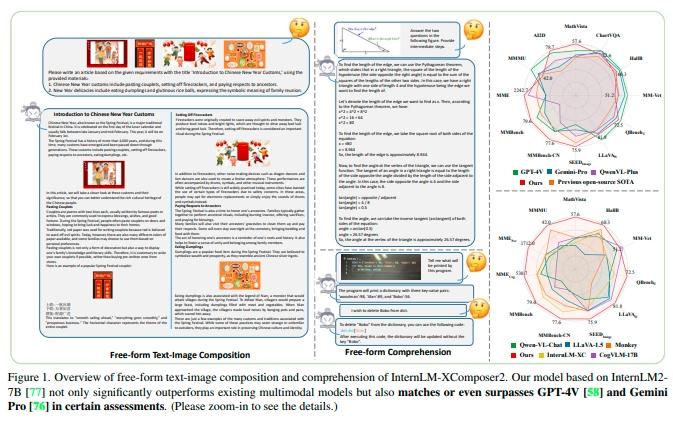

InternLM-XComposer2

擅长自由格式图文合成,如定制广告海报生成,部分能力接近GPT-4V和Gemini Pro。

二、垂直领域突破模型

-

mPLUG-PaperOwl

专攻科学图表解析,可分析论文中的Latex图表并生成解释,助力学术研究。

三、性能榜单与社区热度

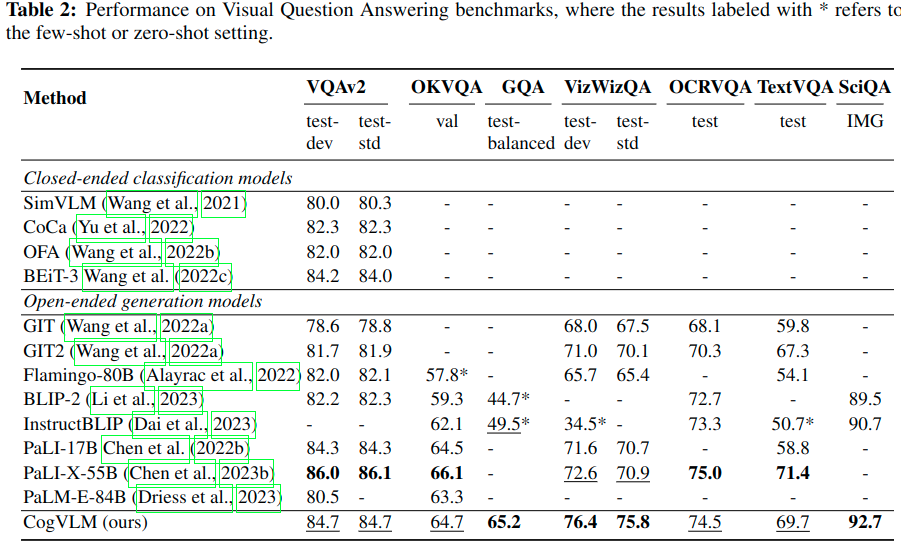

- 感知类任务:BLIP-2综合评分最高,擅长图像分类、目标检测等基础任务。

- 认知类任务:MiniGPT-4在复杂推理任务中领先,InstructBLIP紧随其后。

- 社区活跃度:GitHub上Multimodal-GPT、AntMMF等框架提供完整训练工具链。

四、技术趋势与挑战

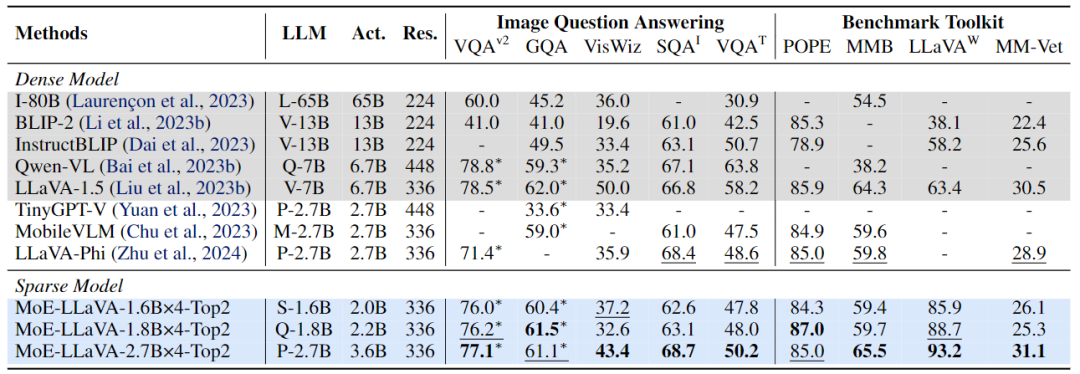

- 高效部署:如MobileVLM在移动端实现每秒65.3 token的推理速度,推动边缘计算落地。

- 数据瓶颈:Leopard通过百万级人工+合成数据解决高质量多模态数据集短缺问题。

- 伦理风险:xGen-MM采用安全微调技术减少生成有害内容的可能性。

如需特定模型的代码或论文,可参考CSDN、GitHub等平台的整理资源。