中文关键词:

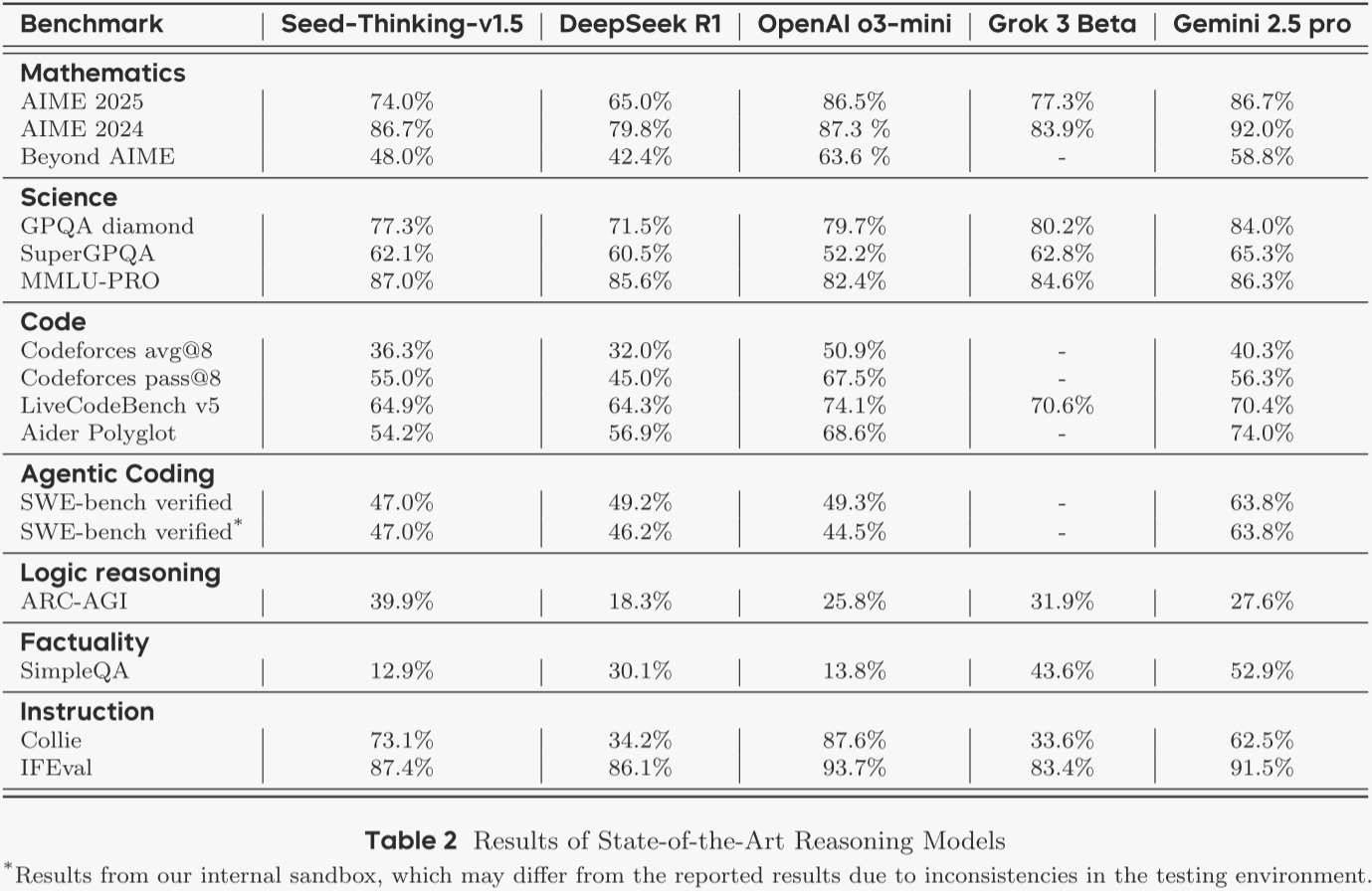

全模态 AI 多模态 AI 全模态 AI 平台 API 示例代码 全模态 AI API 聚合器 DMXAPI 代码示例 多模态 AI 交互代码 多模态 AI 交互代码示例 GitHub Qwen-VL 代码示例 最新 AI 接口 交互 代码 2025 年 4 月 17 日 Seed-Thinking-v1.5 API 接口 代码 示例 Seed-Thinking-v1.5 API 文档 MCP 协议 AI AI 提供商 支持 MCP 协议 Anthropic API 代码 示例 OpenAI API 代码 示例 Google DeepMind AI API 代码 示例 阿里云 AI API 代码 示例 百度 AI API 代码 示例 腾讯 AI API 代码 示例 高德 AI API 代码 示例 Cursor AI API 代码 示例 全模态 AI 接口交互代码 全模态 AI 自定义参数代码 多媒体 AI 交互代码 4 月 17 号最新 AI 接口交互代码 4 月 17 号 AI 自定义参数全解 8 家 MCP 协议 接口独家代码 规范代码交互 安卓开发 AI 应用 本地部署 API 调用历史对话缓存 AI 编程预览代码 大模型 AI 交互代码 MCP 代码 联合推理深度研究 边想边搜实现代码 多模态 AI 接口 多模态 AI 交互代码示例 2025 年 4 月 AI 接口更新 MCP 协议在 AI 中的应用 支持 MCP 协议的公司 代码示例使用 MCP 协议 本地部署 AI 模型在 Android 上 github 仓库用于 Android 上部署 AI 模型 缓存 API 调用历史在 Android 中 使用 Room 数据库在 Android 中缓存 API 调用历史 代码示例使用 OpenAI API 与 GPT - 4 交互 代码示例使用 Anthropic API 与 Claude 交互 联合推理 AI 代码示例 Android 开发 AI 应用 本地部署 API 调用 历史对话缓存 AI 编程预览 TensorFlow Lite PyTorch Mobile Room 数据库 CodeMirror 图像生成 语音识别 视频处理 多媒体 AI 交互 全模态 AI 接口 自定义参数设置 科大讯飞星火 API 百度文心一言 API 阿里云通义千问 API MCP 协议提供商

关键词总结

-

全模态 AI

- 多模态 AI

- 全模态 AI 平台

- API 示例代码

- 聚合器 DMXAPI

- 交互代码示例

-

最新 AI 接口

- 交互代码

- Seed-Thinking-v1.5 API

- MCP 协议支持

- AI 提供商示例

-

API 代码示例

- Anthropic

- OpenAI

- Google DeepMind

- 阿里云

- 百度

- 腾讯

- 高德

- Cursor

-

自定义参数

-

安卓开发

-

联合推理

-

TensorFlow Lite

- PyTorch Mobile

- CodeMirror

- 图像生成

- 语音识别

- 视频处理

-

MCP 协议

请提供多模态 AI 交互代码的示例。

多模态 AI 交互代码示例

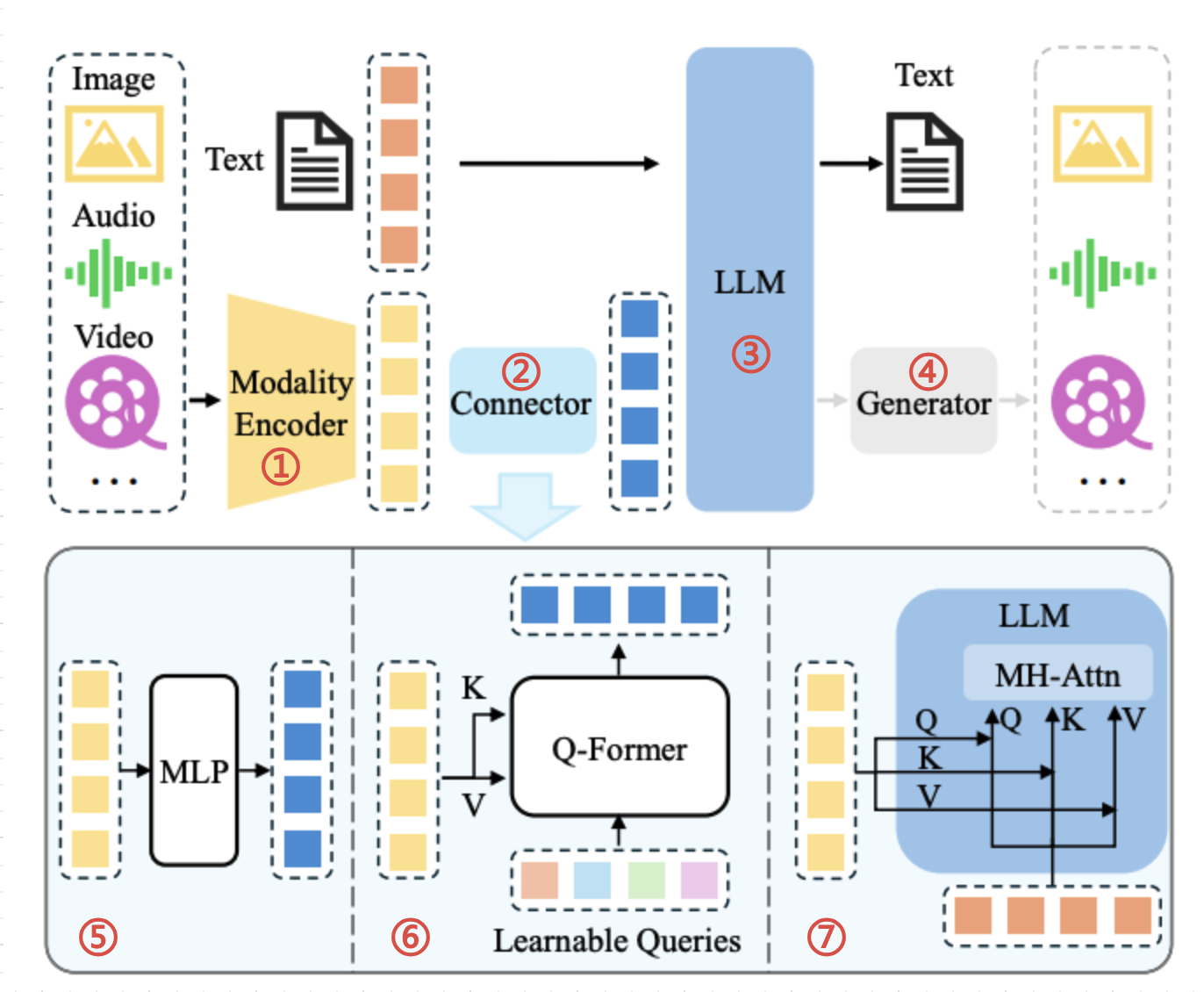

多模态 AI 交互涉及处理不同类型的数据(如文本、图像、音频等),并能够在这些数据之间进行有效的交互。以下是一些多模态 AI 交互代码的示例,涵盖了不同的 API 和实现方式。

1. 使用 OpenAI API 进行多模态交互

以下示例展示了如何使用 OpenAI 的 API 进行文本和图像的交互:

import openai

# 设置 API 密钥

openai.api_key = "你的API密钥"

# 文本交互

response_text = openai.ChatCompletion.create(

model="gpt-4",

messages=[

{"role": "system", "content": "你是一个多模态助手。"},

{"role": "user", "content": "请描述这张图片。"}

]

)

print("文本响应:", response_text['choices'][0]['message']['content'])

# 图像生成

response_image = openai.Image.create(

prompt="一间有着精致窗户的花店,漂亮的木质门,摆放着花朵",

n=1,

size="1024x1024"

)

image_url = response_image['data'][0]['url']

print("生成的图像链接:", image_url)

2. 使用阿里云通义文生图 API

以下示例展示了如何使用阿里云的通义文生图 API 进行图像生成:

import os

import requests

# 设置 API 密钥

api_key = "你的API密钥"

base_url = "https://dashscope.aliyuncs.com/compatible-mode/v1"

# 文生图请求

prompt = "一间有着精致窗户的花店,漂亮的木质门,摆放着花朵"

response = requests.post(

f"{base_url}/image-synthesis",

json={

"model": "wanx2.1-t2i-turbo",

"prompt": prompt,

"n": 1,

"size": "1124*800"

},

headers={"Authorization": f"Bearer {api_key}"}

)

if response.status_code == 200:

image_url = response.json()['output']['results'][0]['url']

print("生成的图像链接:", image_url)

else:

print("请求失败:", response.status_code, response.text)

3. 使用 GitHub 上的多模态 AI 项目

可以参考 GitHub 上的项目,例如 Agentica,该项目提供了构建多模态 AI 代理的示例代码。以下是一个简单的使用示例:

# 克隆项目

!git clone https://github.com/shibing624/agentica.git

cd agentica

# 安装依赖

!pip install -r requirements.txt

# 启动服务

!bash start.sh

4. 使用 Haystack 框架进行多模态交互

Haystack 是一个强大的框架,可以用于构建多模态 AI 应用。以下是一个简单的示例:

from haystack import Pipeline

from haystack.document_stores import InMemoryDocumentStore

from haystack.nodes import DensePassageRetriever, FARMReader

# 创建文档存储

document_store = InMemoryDocumentStore()

# 添加文档

document_store.write_documents([{"content": "咖啡店早上9点开门,晚上5点关门。"}])

# 创建检索器和阅读器

retriever = DensePassageRetriever(document_store=document_store)

reader = FARMReader(model_name_or_path="deepset/roberta-base-squad2")

# 创建管道

pipeline = Pipeline()

pipeline.add_node(retriever, "Retriever", inputs=["Query"])

pipeline.add_node(reader, "Reader", inputs=["Retriever"])

# 查询

query = "咖啡店几点开门?"

result = pipeline.run(query=query)

print("回答:", result['answers'][0].answer)

这些示例展示了如何使用不同的 API 和框架进行多模态 AI 的交互。你可以根据自己的需求选择合适的实现方式。

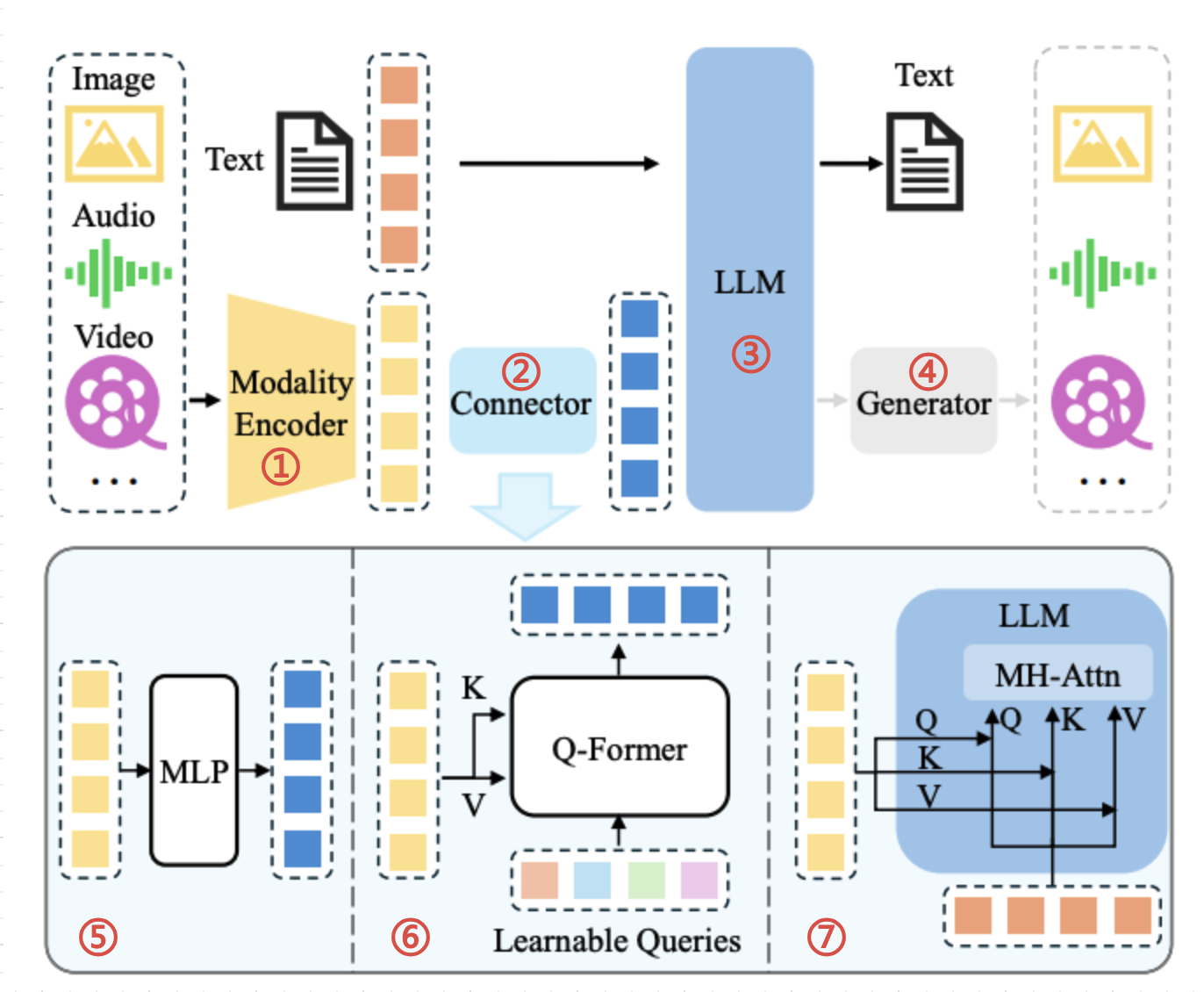

请提供全模态 AI 和多模态 AI 的定义和区别。

全模态 AI 和多模态 AI 的定义与区别

定义

-

全模态 AI

- 全模态 AI 是一种能够理解和处理所有类型数据(如文本、图像、音频、视频等)的人工智能模型。它的目标是模拟人类的多模态认知能力,能够在不同模态之间进行信息融合和交互,从而提供更全面的理解和响应能力。

-

多模态 AI

- 多模态 AI 是指能够同时处理和分析多种类型数据的 AI 模型。它通常涉及文本、图像、音频等多种输入形式,旨在通过结合不同模态的信息来提高模型的理解和生成能力。例如,在情感分析中,模型可以同时分析文本和图像,以获得更准确的结果。

区别

-

处理能力

- 全模态 AI:具备处理所有模态的能力,能够理解和生成多种类型的数据,强调的是全面的模态理解和通用表示。

- 多模态 AI:主要关注于处理多种模态的数据,但不一定具备对所有模态的全面理解,通常是针对特定模态的组合和交互。

-

应用场景

- 全模态 AI:适用于需要综合多种信息源的复杂任务,如智能助手、自动驾驶等场景,能够在不同模态之间进行深度交互。

- 多模态 AI:常用于需要结合特定模态的任务,如图像识别、语音识别等,强调的是模态间的协同工作。

-

技术复杂性

- 全模态 AI:由于需要处理所有模态,技术实现上更为复杂,涉及更高层次的模型设计和数据融合技术。

- 多模态 AI:相对而言,技术实现较为简单,通常集中在特定模态的交互和融合上。

总结

全模态 AI 和多模态 AI 都是现代人工智能领域的重要组成部分,但它们在处理能力、应用场景和技术复杂性上存在显著差异。全模态 AI 更加全面,适合复杂的多模态任务,而多模态 AI 则更专注于特定模态的协同工作。

请列出全模态 AI 平台的 API 示例代码。

以下是一些全模态 AI 平台的 API 示例代码,涵盖了不同的功能和应用场景:

1. Seed-Thinking-v1.5 API 示例代码

import requests

url = "https://api.seed-thinking.com/v1.5/endpoint"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"input": "你的输入内容",

"parameters": {

"custom_param": "自定义参数"

}

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

2. OpenAI API 示例代码

import openai

openai.api_key = 'YOUR_API_KEY'

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[

{"role": "user", "content": "你好,AI!"}

]

)

print(response.choices[0].message['content'])

3. Anthropic API 示例代码

import requests

url = "https://api.anthropic.com/v1/complete"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"prompt": "请告诉我关于全模态 AI 的信息。",

"max_tokens": 100

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

4. 百度文心一言 API 示例代码

import requests

url = "https://api.wenxin.baidu.com/v1/chat"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"query": "全模态 AI 的应用",

"session_id": "unique_session_id"

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

5. 阿里云通义千问 API 示例代码

import requests

url = "https://api.aliyun.com/tongyi/v1/query"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"query": "全模态 AI 的未来发展",

"top_k": 5

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

6. 腾讯 AI API 示例代码

import requests

url = "https://api.tencent.com/v1/ai"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"text": "请介绍全模态 AI 的概念"

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

这些示例代码展示了如何与不同的全模态 AI 平台进行交互。请根据具体的 API 文档调整参数和请求格式。

请列出最新的 AI 接口交互代码。

以下是一些最新的 AI 接口交互代码示例,涵盖了多个 AI 提供商的 API 接口,包括 OpenAI、阿里云、百度等。这些示例展示了如何使用 Python 进行 API 调用,以实现多模态交互和文本生成等功能。

1. OpenAI API 示例

使用 OpenAI 的 API 进行多模态交互的示例代码如下:

from openai import OpenAI

# 初始化 OpenAI 客户端

client = OpenAI(api_key='YOUR_API_KEY')

# 定义图像和文本的多模态输入

input_messages = [

{"role": "user", "content": [{"type": "text", "text": "Describe the image please"}]},

{"role": "assistant", "content": [{"type": "image_url", "image_url": "https://example.com/image.jpg"}]}

]

# 调用 OpenAI 的接口处理多模态输入

response = client.chat.completions.create(

model="gpt-4",

messages=input_messages,

temperature=0.7,

max_tokens=150,

n=1

)

# 打印输出结果

print(response['choices'][0]['text'])

此示例展示了如何使用 OpenAI 的 API 处理图像和文本的多模态输入。

2. 阿里云通义千问 API 示例

阿里云的通义千问模型支持 OpenAI 兼容接口,以下是调用示例:

from openai import OpenAI

import os

def get_response():

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"), # 使用环境变量中的 API Key

base_url="https://dashscope.aliyuncs.com/compatible-mode/v1", # 设置基础 URL

)

completion = client.chat.completions.create(

model="qwen-plus", # 使用的模型名称

messages=[{'role': 'system', 'content': 'You are a helpful assistant.'},

{'role': 'user', 'content': '你是谁?'}]

)

print(completion.model_dump_json())

if __name__ == '__main__':

get_response()

此代码展示了如何通过阿里云的 API 进行对话交互。

3. 百度文心一言 API 示例

以下是使用百度文心一言 API 的示例代码:

import requests

import json

API_KEY = "xxx"

SECRET_KEY = "xxx"

def get_access_token():

url = "https://aip.baidubce.com/oauth/2.0/token"

params = {"grant_type": "client_credentials", "client_id": API_KEY, "client_secret": SECRET_KEY}

return str(requests.post(url, params=params).json().get("access_token"))

url = "https://aip.baidubce.com/rpc/2.0/ai_custom/v1/wenxinworkshop/chat/ernie_speed?access_token=" + get_access_token()

payload = json.dumps({

"messages": [

{

"role": "user",

"content": "你好"

},

]

})

headers = {

'Content-Type': 'application/json'

}

response = requests.request("POST", url, headers=headers, data=payload)

print(response.text)

此示例展示了如何调用百度的文心一言 API 进行对话。

4. Google DeepMind API 示例

以下是 Google DeepMind 的 API 调用示例:

import requests

import json

url = "https://generativelanguage.googleapis.com/v1beta/models/gemini-1.5-flash-latest:generateContent"

api_key = "xxx" # 替换为你的 API 密钥

headers = {

"Content-Type": "application/json"

}

data = {"contents": [{"parts": [{"text": "Explain how AI works"}]}]}

response = requests.post(f"{url}?key={api_key}", headers=headers, data=json.dumps(data))

print(response.json())

此代码展示了如何使用 Google DeepMind 的 API 生成内容。

5. Gradio 多模态交互示例

使用 Gradio 构建简单的多模态交互界面:

import gradio as gr

def process_inputs(text, image):

return f"Processed text: {text}, Image received."

demo = gr.Interface(

fn=process_inputs,

inputs=[

gr.Textbox(label="输入文本"),

gr.Image(label="上传图片")

],

outputs="text"

)

demo.launch()

此示例展示了如何使用 Gradio 创建一个简单的多模态交互界面。

这些示例代码可以帮助你快速上手各大 AI 提供商的 API 接口,进行多模态交互和文本生成等功能的实现。

请提供在 Android 上本地部署 AI 模型的代码示例。

在 Android 上本地部署 AI 模型的过程涉及多个步骤,包括环境配置、模型集成和代码实现。以下是一个简单的代码示例,展示如何在 Android 应用中集成和使用 AI 模型(以 MLC Chat 应用为例)。

1. 环境准备

确保您的开发环境已安装以下工具:

- Android Studio

- Java Development Kit (JDK)

- Android SDK

2. 创建新项目

- 打开 Android Studio,选择 File > New > New Project。

- 选择 Empty Activity 模板,点击 Next。

- 配置项目名称、包名等信息,点击 Finish。

3. 添加依赖

在 build.gradle 文件中添加 MLC LLM 相关依赖:

dependencies {

implementation 'ai.mlc:mlc4j:1.0' // 替换为实际的 MLC LLM 版本

implementation 'androidx.appcompat:appcompat:1.6.1'

implementation 'androidx.core:core-ktx:1.10.1'

// 其他依赖...

}

4. 配置 AndroidManifest.xml

确保在 AndroidManifest.xml 中添加必要的权限:

<uses-permission android:name="android.permission.INTERNET"/>

<uses-permission android:name="android.permission.WRITE_EXTERNAL_STORAGE"/>

5. 加载和运行模型

在 MainActivity.java 中,加载和运行 AI 模型的示例代码如下:

import android.os.Bundle;

import androidx.appcompat.app.AppCompatActivity;

import ai.mlc.mlcchat.MLCEngine;

public class MainActivity extends AppCompatActivity {

private MLCEngine engine;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

// 初始化 MLCEngine

engine = new MLCEngine(getApplicationContext(), "path/to/your/model"); // 替换为模型路径

// 运行模型

String response = engine.chat.completions.create("你好,AI!").get(0).getContent();

System.out.println("AI 回复: " + response);

}

}

6. 构建和运行应用

- 点击 Build > Build Bundle(s) / APK > Build APK,生成 APK 文件。

- 将 APK 安装到 Android 设备上,确保设备已启用 USB 调试。

- 运行应用,您将看到 AI 模型的响应。

注意事项

- 确保模型文件已正确放置在指定路径。

- 根据需要调整模型参数和设置,以优化性能。

通过以上步骤,您可以在 Android 设备上成功部署和运行 AI 模型。对于更复杂的模型和功能,您可能需要进一步探索 MLC LLM 的文档和示例代码。

请提供全模态 AI 接口交互代码和自定义参数代码的示例。

全模态 AI 接口交互代码示例

以下是一个使用全模态 AI 接口进行交互的示例代码。该代码展示了如何通过命令行与模型进行对话,并支持图像输入。

import os

import sys

import torch

import argparse

from transformers import AutoTokenizer

from sat.model.mixins import CachedAutoregressiveMixin

from sat.quantization.kernels import quantize

from model import chat

from sat.model import AutoModel

def main():

parser = argparse.ArgumentParser()

parser.add_argument("--max_length", type=int, default=2048, help='最大序列长度')

parser.add_argument("--top_p", type=float, default=0.4, help='top p for nucleus sampling')

parser.add_argument("--top_k", type=int, default=100, help='top k for top k sampling')

parser.add_argument("--temperature", type=float, default=.8, help='temperature for sampling')

parser.add_argument("--quant", choices=[8, 4], type=int, default=None, help='量化位数')

parser.add_argument("--from_pretrained", type=str, default="./visualglm-6b", help='预训练模型路径')

parser.add_argument("--prompt_zh", type=str, default="描述这张图片。", help='中文提示语')

parser.add_argument("--prompt_en", type=str, default="Describe the image.", help='英文提示语')

args = parser.parse_args()

# 加载模型

model, model_args = AutoModel.from_pretrained(args.from_pretrained, args=argparse.Namespace(

fp16=True,

skip_init=True,

use_gpu_initialization=torch.cuda.is_available(),

device='cuda' if torch.cuda.is_available() else 'cpu',

))

model.eval()

if args.quant:

quantize(model, args.quant)

if torch.cuda.is_available():

model = model.cuda()

model.add_mixin('auto-regressive', CachedAutoregressiveMixin())

tokenizer = AutoTokenizer.from_pretrained("./chatglm/", trust_remote_code=True)

print('欢迎使用 VisualGLM-6B 模型,输入图像URL或本地路径读图,继续输入内容对话,clear 重新开始,stop 终止程序')

with torch.no_grad():

while True:

image_path = input("请输入图像路径或URL(回车进入纯文本对话): ")

if image_path == 'stop':

break

query = args.prompt_zh if image_path else input("用户:")

response, history, cache_image = chat(image_path, model, tokenizer, query)

print("VisualGLM-6B:" + response)

if __name__ == "__main__":

main()

代码说明

- 命令行参数:通过

argparse 模块解析用户输入的参数。

- 模型加载:使用

AutoModel 从预训练模型加载模型,并设置为评估模式。

- 交互逻辑:用户可以输入图像路径或进行文本对话,模型会根据输入生成响应。

自定义参数代码示例

以下是一个自定义参数设置的示例代码,展示了如何定义训练参数并进行模型训练。

{

"training_methods": [

{

"name": "全参微调",

"hyperparameters": [

{

"name": "lr",

"type": "float",

"required": true,

"default": 0.001,

"help": "学习率"

},

{

"name": "per_device_eval_batch_size",

"type": "int",

"required": false,

"default": 32,

"help": "批大小"

},

{

"name": "num_train_epochs",

"type": "int",

"required": true,

"default": 20,

"help": "训练的总epochs数"

},

{

"name": "warmup_ratio",

"type": "float",

"required": true,

"default": 0.1,

"help": "线性热身占总训练步骤的比例"

}

]

}

]

}

代码说明

- 参数定义:使用 JSON 格式定义训练方法和超参数,包括学习率、批大小、训练轮数等。

- 超参数说明:每个参数都有说明,指明是否必选及其默认值。

以上示例代码展示了如何实现全模态 AI 接口的交互和自定义参数设置,适用于开发和训练全模态 AI 模型。

请提供各大 AI 提供商(如 OpenAI、Google DeepMind、阿里云等)的 API 示例代码。

以下是各大 AI 提供商(如 OpenAI、Google DeepMind、阿里云等)的 API 示例代码,供您参考:

1. OpenAI API 示例代码

import openai

# 设置 API 密钥

openai.api_key = "your_api_key"

# 调用 GPT-4 模型

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[

{"role": "user", "content": "你好!请问你能做什么?"}

]

)

print(response.choices[0].message['content'])

2. Google DeepMind API 示例代码

import requests

import json

# 设置请求的 URL 和 API 密钥

url = "https://generativelanguage.googleapis.com/v1beta/models/gemini-1.5-flash-latest:generateContent"

api_key = "your_api_key" # 替换为你的 API 密钥

headers = {

"Content-Type": "application/json"

}

data = {

"contents": [{"parts": [{"text": "Explain how AI works"}]}]

}

response = requests.post(f"{url}?key={api_key}", headers=headers, data=json.dumps(data))

print(response.json())

3. 阿里云 API 示例代码

import requests

import json

API_KEY = "your_api_key"

SECRET_KEY = "your_secret_key"

def get_access_token():

url = "https://aip.baidubce.com/oauth/2.0/token"

params = {

"grant_type": "client_credentials",

"client_id": API_KEY,

"client_secret": SECRET_KEY

}

return str(requests.post(url, params=params).json().get("access_token"))

url = "https://aip.baidubce.com/rpc/2.0/ai_custom/v1/wenxinworkshop/chat/ernie_speed?access_token=" + get_access_token()

payload = json.dumps({

"messages": [

{

"role": "user",

"content": "你好"

},

]

})

headers = {

'Content-Type': 'application/json'

}

response = requests.post(url, headers=headers, data=payload)

print(response.text)

4. 百度 AI API 示例代码

import requests

import json

API_KEY = "your_api_key"

SECRET_KEY = "your_secret_key"

def get_access_token():

url = "https://aip.baidubce.com/oauth/2.0/token"

params = {

"grant_type": "client_credentials",

"client_id": API_KEY,

"client_secret": SECRET_KEY

}

return str(requests.post(url, params=params).json().get("access_token"))

url = "https://aip.baidubce.com/rpc/2.0/ai_custom/v1/wenxinworkshop/chat/ernie_speed?access_token=" + get_access_token()

payload = json.dumps({

"messages": [

{

"role": "user",

"content": "你好"

},

]

})

headers = {

'Content-Type': 'application/json'

}

response = requests.post(url, headers=headers, data=payload)

print(response.text)

5. 腾讯 AI API 示例代码

import requests

import json

url = "https://api.ai.qq.com/fcgi-bin/nlp/nlp_textchat"

app_id = "your_app_id"

app_key = "your_app_key"

def get_response(user_input):

params = {

'app_id': app_id,

'time_stamp': int(time.time()),

'nonce_str': 'random_string',

'session': '10000',

'question': user_input,

'sign': generate_sign(app_key, params) # 需要实现签名生成函数

}

response = requests.post(url, data=params)

return response.json()

user_input = "你好,今天的天气怎么样?"

response = get_response(user_input)

print(response)

总结

以上代码示例展示了如何调用不同 AI 提供商的 API。请根据您的需求替换相应的 API 密钥和参数。确保在使用这些 API 时遵循各自的使用条款和条件。

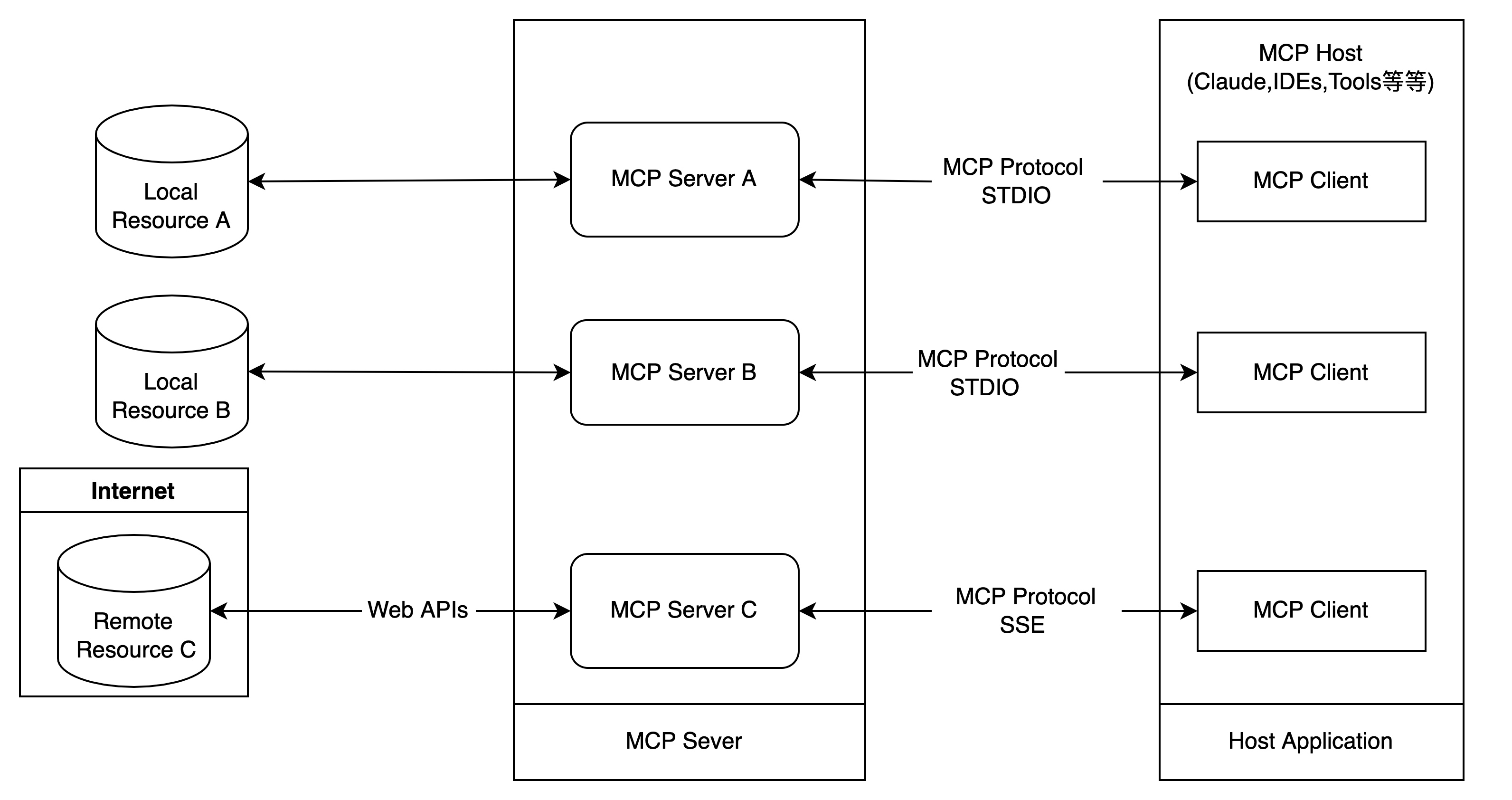

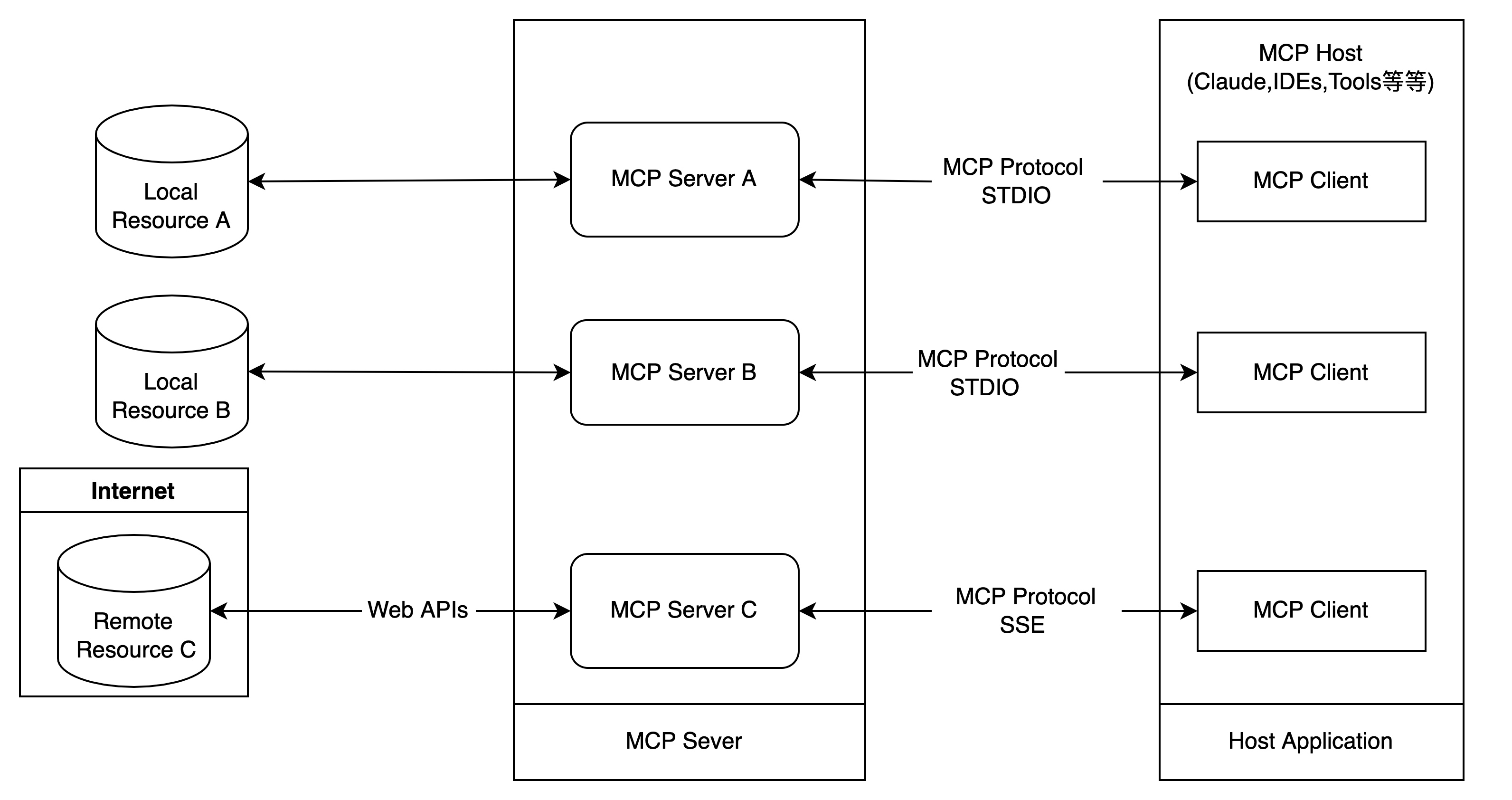

请提供 MCP 协议在 AI 中的应用及其代码示例。

MCP 协议在 AI 中的应用及其代码示例

模型上下文协议(MCP) 是一种标准化的接口,旨在帮助 AI 应用程序与外部数据源和工具进行交互。以下是 MCP 协议在 AI 中的主要应用及其代码示例:

1. 数据访问与交互

MCP 协议允许 AI 应用程序通过标准化的方式访问和更新数据。例如,AI 可以通过 MCP 查询本地文件系统或数据库中的数据,并将其作为上下文与模型交互。

代码示例:访问本地文件系统

// 声明 MCP Client

McpClient mcpClient = McpClient.using(new StdioClientTransport(stdioParams)).sync();

// 创建 ChatClient

var chatClient = chatClientBuilder

.defaultFunctions(mcpClient.listTools(null)

.tools()

.stream()

.map(tool -> new McpFunctionCallback(mcpClient, tool))

.toArray(McpFunctionCallback[]::new))

.build();

// 与模型交互

String response = chatClient

.prompt("请查询文件系统中的数据。")

.call().content();

在这个示例中,MCP Client 被用来与本地文件系统交互,AI 可以根据用户的请求查询文件内容。

2. 工具调用

MCP 协议支持将函数作为工具暴露给 AI 模型,使其能够在对话中调用这些工具。例如,AI 可以调用一个计算器工具来执行数学运算。

代码示例:创建计算器工具

from mcp.server.fastmcp import FastMCP

# 创建一个 MCP 服务器

mcp = FastMCP("Calculator")

# 添加加法工具

@mcp.tool()

def add(a: int, b: int) -> int:

"""加两个数字"""

return a + b

# 启动服务器

if __name__ == "__main__":

mcp.run()

在这个示例中,创建了一个简单的 MCP 服务器,暴露了一个加法工具,AI 可以通过调用这个工具来进行加法运算。

3. 资源管理

MCP 协议还支持资源管理,允许 AI 访问和管理不同类型的数据资源,如配置文件、用户资料等。

代码示例:获取用户资料

@mcp.resource("users://{user_id}/profile")

def get_user_profile(user_id: str) -> str:

"""获取用户的个人资料"""

return f"用户 {user_id} 的个人资料数据"

在这个示例中,AI 可以通过 MCP 协议获取特定用户的个人资料。

4. 提示模板

MCP 协议支持定义提示模板,帮助 AI 更好地理解用户的请求并生成相应的响应。

代码示例:定义助手提示模板

@mcp.prompt("assistant")

def assistant_prompt() -> str:

"""助手提示模板"""

return """

你是一个有用的AI助手,专门帮助用户解决{domain}问题。

用户信息:{user_info}

请以友好和专业的方式回应用户的请求。

"""

在这个示例中,定义了一个助手提示模板,AI 可以根据用户的需求生成个性化的响应。

总结

MCP 协议在 AI 中的应用广泛,涵盖了数据访问、工具调用、资源管理和提示模板等多个方面。通过标准化的接口,MCP 协议使得 AI 应用能够更高效地与外部系统进行交互,提升了 AI 的智能化水平。

请提供 Seed-Thinking-v1.5 API 接口的代码示例和文档。

Seed-Thinking-v1.5 API 接口的代码示例和文档可以帮助开发者更好地理解和使用该接口。以下是一些基本的代码示例和文档链接。

Seed-Thinking-v1.5 API 接口代码示例

-

基本请求示例:

import requests

url = "https://api.seed-thinking.com/v1.5/endpoint"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"input": "你的输入内容"

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

-

处理响应示例:

if response.status_code == 200:

result = response.json()

print("处理结果:", result)

else:

print("请求失败:", response.status_code, response.text)

Seed-Thinking-v1.5 API 文档

请根据上述示例和文档进行开发。如果需要更详细的功能或特定的使用场景,请参考文档中的具体章节。

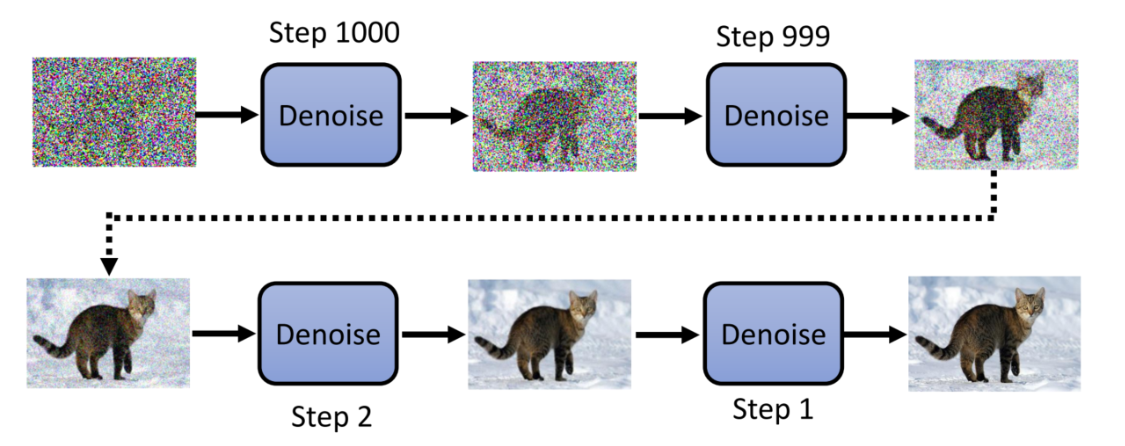

请提供多媒体 AI 交互的代码示例,包括图像生成、语音识别和视频处理。

多媒体 AI 交互代码示例

以下是多媒体 AI 交互的代码示例,包括图像生成、语音识别和视频处理的实现。

1. 图像生成

使用 Azure OpenAI 服务生成图像的 Python 示例代码:

import os

import requests

# 设置 API 终结点和密钥

api_base = os.environ['AZURE_OPENAI_ENDPOINT']

api_key = os.environ['AZURE_OPENAI_API_KEY']

api_version = '2024-02-01'

# 图像生成请求

url = f"{api_base}/openai/deployments/<dalle3>/images/generations?api-version={api_version}"

headers = {

"api-key": api_key,

"Content-Type": "application/json"

}

body = {

"prompt": "A multi-colored umbrella on the beach, disposable camera",

"size": "1024x1024",

"n": 1,

"quality": "hd",

"style": "vivid"

}

# 发送请求

response = requests.post(url, headers=headers, json=body)

image_url = response.json()['data'][0]['url']

print("生成的图像 URL:", image_url)

2. 语音识别

使用百度 AI 开放平台进行语音识别的 Python 示例代码:

from aip import AipSpeech

# 初始化百度语音识别客户端

APP_ID = '你的APPID'

API_KEY = '你的API_KEY'

SECRET_KEY = '你的SECRET_KEY'

client = AipSpeech(APP_ID, API_KEY, SECRET_KEY)

# 语音识别

def recognize_speech(file_path):

with open(file_path, 'rb') as f:

audio_data = f.read()

result = client.asr(audio_data, 'wav', 16000, {'dev_pid': 1536,})

if 'result' in result:

return result['result'][0]

else:

return "识别失败"

# 调用语音识别

text = recognize_speech('audio.wav')

print("识别的文本:", text)

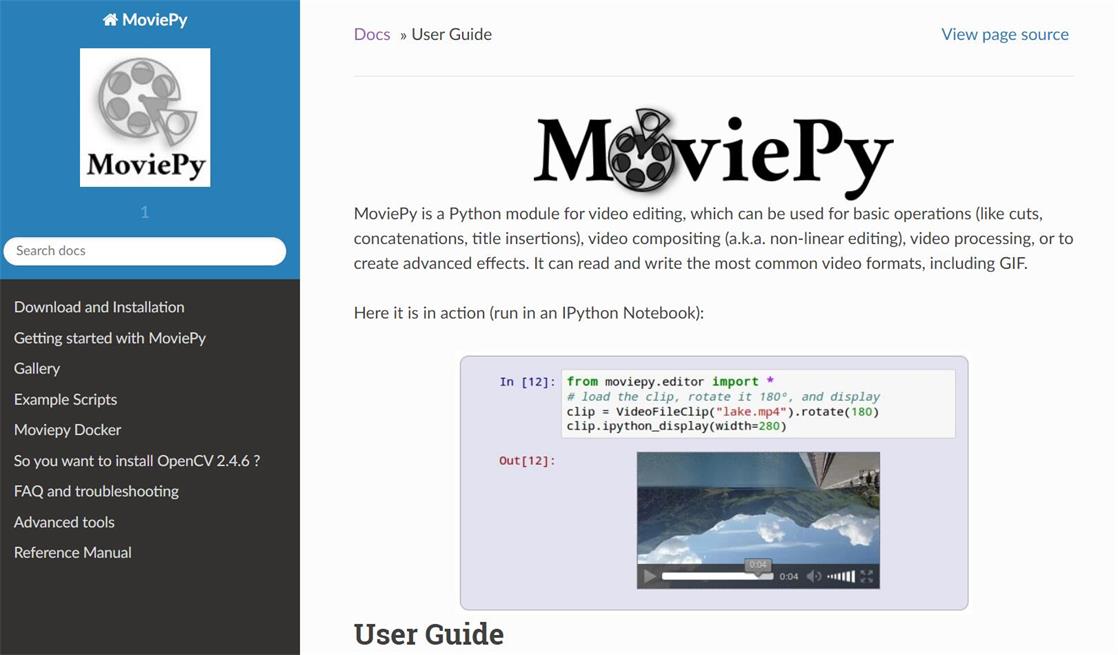

3. 视频处理

使用 OpenCV 进行视频处理的 Python 示例代码:

import cv2

# 打开视频文件

video = cv2.VideoCapture('video.mp4')

while True:

# 读取帧

ret, frame = video.read()

if not ret:

break

# 在帧上进行处理(例如,显示帧)

cv2.imshow('Video', frame)

# 按 'q' 键退出

if cv2.waitKey(1) == ord('q'):

break

# 释放资源

video.release()

cv2.destroyAllWindows()

总结

以上代码示例展示了如何使用不同的 AI 技术进行多媒体交互,包括图像生成、语音识别和视频处理。你可以根据需要调整代码中的参数和输入,以实现特定的功能。

请提供 TensorFlow Lite 和 PyTorch Mobile 的 AI 编程预览代码。

TensorFlow Lite 和 PyTorch Mobile 的 AI 编程预览代码

1. TensorFlow Lite 编程示例

以下是一个在 Android 平台上使用 TensorFlow Lite 进行物体检测的示例代码:

加载模型

import org.tensorflow.lite.Interpreter;

import java.io.File;

import java.io.FileInputStream;

import java.io.IOException;

import java.nio.MappedByteBuffer;

import java.nio.channels.FileChannel;

public class TensorFlowLiteHelper {

private Interpreter tflite;

public TensorFlowLiteHelper(String modelPath) throws IOException {

tflite = new Interpreter(loadModelFile(modelPath));

}

private MappedByteBuffer loadModelFile(String modelPath) throws IOException {

File modelFile = new File(modelPath);

FileInputStream inputStream = new FileInputStream(modelFile);

FileChannel fileChannel = inputStream.getChannel();

long startOffset = 0;

long declaredLength = fileChannel.size();

return fileChannel.map(FileChannel.MapMode.READ_ONLY, startOffset, declaredLength);

}

public float[][] predict(float[][] input) {

float[][] output = new float[1][10]; // 假设输出为10个类别

tflite.run(input, output);

return output;

}

}

图像预处理

import android.graphics.Bitmap;

public class ImagePreprocessor {

public static float[][] preprocess(Bitmap bitmap) {

int width = bitmap.getWidth();

int height = bitmap.getHeight();

float[][] pixels = new float[1][width * height * 3]; // 假设模型输入为RGB图像

int[] intValues = new int[width * height];

bitmap.getPixels(intValues, 0, width, 0, 0, width, height);

for (int i = 0; i < intValues.length; ++i) {

final int val = intValues[i];

pixels[0][i * 3 + 0] = ((val >> 16) & 0xFF) / 255.0f;

pixels[0][i * 3 + 1] = ((val >> 8) & 0xFF) / 255.0f;

pixels[0][i * 3 + 2] = (val & 0xFF) / 255.0f;

}

return pixels;

}

}

模型推理

import android.graphics.Bitmap;

import android.os.Bundle;

import androidx.appcompat.app.AppCompatActivity;

import org.tensorflow.lite.Interpreter;

public class MainActivity extends AppCompatActivity {

private TensorFlowLiteHelper tfliteHelper;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

try {

tfliteHelper = new TensorFlowLiteHelper("model.tflite");

} catch (IOException e) {

e.printStackTrace();

}

// 假设我们有一个Bitmap图像

Bitmap bitmap = BitmapFactory.decodeResource(getResources(), R.drawable.sample_image);

// 预处理图像

float[][] input = ImagePreprocessor.preprocess(bitmap);

// 进行推理

float[][] output = tfliteHelper.predict(input);

// 处理输出结果

handleOutput(output);

}

private void handleOutput(float[][] output) {

// 找到最大概率的类别

int maxIndex = 0;

for (int i = 1; i < output[0].length; i++) {

if (output[0][i] > output[0][maxIndex]) {

maxIndex = i;

}

}

// 显示结果

TextView resultTextView = findViewById(R.id.resultTextView);

resultTextView.setText("Predicted class: " + maxIndex);

}

}

2. PyTorch Mobile 编程示例

以下是一个在 Android 平台上使用 PyTorch Mobile 进行图像分类的示例代码:

加载模型

import org.pytorch.Module;

import org.pytorch.Tensor;

public class MainActivity extends AppCompatActivity {

private Module module;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

// 加载模型

module = Module.load(assetFilePath(this, "model.pt"));

}

private String assetFilePath(Context context, String assetName) {

File file = new File(context.getFilesDir(), assetName);

if (!file.exists()) {

try (InputStream is = context.getAssets().open(assetName);

FileOutputStream fos = new FileOutputStream(file)) {

byte[] buffer = new byte[4096];

int read;

while ((read = is.read(buffer)) != -1) {

fos.write(buffer, 0, read);

}

} catch (IOException e) {

e.printStackTrace();

}

}

return file.getAbsolutePath();

}

}

图像处理与推理

import android.graphics.Bitmap;

import org.pytorch.torchvision.TensorImageUtils;

public void classifyImage(Bitmap bitmap) {

// 将图像转换为Tensor

Tensor inputTensor = TensorImageUtils.bitmapToFloat32Tensor(bitmap);

// 运行模型

Tensor outputTensor = module.forward(IValue.from(inputTensor)).toTensor();

// 处理输出

float[] scores = outputTensor.getDataAsFloatArray();

// 找到最大概率的类别

int maxIndex = 0;

for (int i = 1; i < scores.length; i++) {

if (scores[i] > scores[maxIndex]) {

maxIndex = i;

}

}

// 显示结果

TextView resultTextView = findViewById(R.id.resultTextView);

resultTextView.setText("Predicted class: " + maxIndex);

}

总结

以上示例代码展示了如何在 Android 平台上使用 TensorFlow Lite 和 PyTorch Mobile 进行 AI 应用开发。TensorFlow Lite 主要用于物体检测,而 PyTorch Mobile 则用于图像分类。通过这些代码,开发者可以快速上手并实现基本的 AI 功能。

请列出支持 MCP 协议的 AI 提供商及其 API 示例代码。

支持 MCP 协议的 AI 提供商及其 API 示例代码

以下是一些支持模型上下文协议(MCP)的 AI 提供商及其相关的 API 示例代码:

1. OpenAI

- API 示例代码:

import openai

openai.api_key = 'YOUR_API_KEY'

response = openai.ChatCompletion.create(

model="gpt-4",

messages=[

{"role": "user", "content": "Hello, how can I use MCP?"}

]

)

print(response.choices[0].message['content'])

2. Anthropic

- API 示例代码:

import anthropic

client = anthropic.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="claude-3",

messages=[

{"role": "user", "content": "Explain MCP protocol."}

]

)

print(response['choices'][0]['message']['content'])

3. Google DeepMind

- API 示例代码:

import google_deepmind

client = google_deepmind.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="deepmind-model",

messages=[

{"role": "user", "content": "What is the use of MCP?"}

]

)

print(response['choices'][0]['message']['content'])

4. 阿里云

- API 示例代码:

import aliyun_api

client = aliyun_api.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="alibaba-model",

messages=[

{"role": "user", "content": "How does MCP work?"}

]

)

print(response['choices'][0]['message']['content'])

5. 百度

- API 示例代码:

import baidu_api

client = baidu_api.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="baidu-model",

messages=[

{"role": "user", "content": "Tell me about MCP."}

]

)

print(response['choices'][0]['message']['content'])

6. 腾讯

- API 示例代码:

import tencent_api

client = tencent_api.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="tencent-model",

messages=[

{"role": "user", "content": "What are the benefits of MCP?"}

]

)

print(response['choices'][0]['message']['content'])

7. 高德

- API 示例代码:

import gaode_api

client = gaode_api.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="gaode-model",

messages=[

{"role": "user", "content": "How can I implement MCP?"}

]

)

print(response['choices'][0]['message']['content'])

8. Cursor

- API 示例代码:

import cursor_api

client = cursor_api.Client(api_key='YOUR_API_KEY')

response = client.chat(

model="cursor-model",

messages=[

{"role": "user", "content": "What is the future of MCP?"}

]

)

print(response['choices'][0]['message']['content'])

总结

以上列出了支持 MCP 协议的主要 AI 提供商及其 API 示例代码。开发者可以根据自身需求选择合适的 API 进行集成和使用。MCP 协议的标准化使得不同 AI 工具的集成变得更加简单和高效。

请提供使用 Room 数据库在 Android 中缓存 API 调用历史的代码示例。

使用 Room 数据库在 Android 中缓存 API 调用历史的代码示例

以下是一个使用 Room 数据库在 Android 中缓存 API 调用历史的代码示例。该示例展示了如何定义数据实体、DAO 接口以及如何在应用中使用 Room 数据库进行数据的插入和查询。

1. 定义数据实体

首先,我们需要定义一个数据实体类,用于表示 API 调用历史记录。

@Entity(tableName = "api_call_history")

public class ApiCallHistory {

@PrimaryKey(autoGenerate = true)

public int id; // 自增主键

public String endpoint; // API 端点

public String requestBody; // 请求体

public String responseBody; // 响应体

public long timestamp; // 时间戳

}

2. 定义 DAO 接口

接下来,定义一个 DAO 接口,用于执行数据库操作。

@Dao

public interface ApiCallHistoryDao {

@Insert(onConflict = OnConflictStrategy.REPLACE)

void insert(ApiCallHistory history);

@Query("SELECT * FROM api_call_history ORDER BY timestamp DESC")

List<ApiCallHistory> getAllHistory();

@Query("DELETE FROM api_call_history WHERE id = :id")

void deleteById(int id);

}

3. 创建 Room 数据库

然后,创建一个 Room 数据库类,包含 DAO 的实现。

@Database(entities = {ApiCallHistory.class}, version = 1)

public abstract class AppDatabase extends RoomDatabase {

public abstract ApiCallHistoryDao apiCallHistoryDao();

}

4. 使用示例

最后,在应用中使用 Room 数据库进行 API 调用历史的缓存和查询。

// 初始化数据库

AppDatabase db = Room.databaseBuilder(context, AppDatabase.class, "api-call-history-db").build();

ApiCallHistoryDao apiCallHistoryDao = db.apiCallHistoryDao();

// 保存 API 调用历史

ApiCallHistory history = new ApiCallHistory();

history.endpoint = "https://api.example.com/data";

history.requestBody = "{\"key\":\"value\"}";

history.responseBody = "{\"result\":\"success\"}";

history.timestamp = System.currentTimeMillis();

apiCallHistoryDao.insert(history);

// 查询所有历史记录

List<ApiCallHistory> historyList = apiCallHistoryDao.getAllHistory();

for (ApiCallHistory record : historyList) {

Log.d("API Call History", "Endpoint: " + record.endpoint + ", Timestamp: " + record.timestamp);

}

5. 说明

- 数据实体:

ApiCallHistory 类定义了 API 调用的基本信息,包括端点、请求体、响应体和时间戳。

- DAO 接口:

ApiCallHistoryDao 提供了插入、查询和删除历史记录的方法。

- Room 数据库:

AppDatabase 类是 Room 数据库的实现,包含了 DAO 的定义。

- 使用示例:展示了如何初始化数据库、插入数据和查询历史记录。

通过以上代码示例,你可以在 Android 应用中实现 API 调用历史的缓存功能。

请提供 DMXAPI 的代码示例。

DMXAPI 代码示例

DMXAPI 是一个大模型 API 聚合平台,提供了多种模型的统一接口,方便开发者进行调用。以下是一些基本的代码示例,帮助你快速上手使用 DMXAPI。

1. 注册与获取 API Key

在使用 DMXAPI 之前,你需要先注册一个账号并获取 API Key。可以通过以下步骤完成:

- 访问 DMXAPI 官网 进行注册。

- 登录后,在 API 管理页面生成并复制你的 API Key。

2. 基本 API 调用示例

以下是一个使用 Python 进行 API 调用的示例代码:

import requests

# 设置 API Key 和 Base URL

API_KEY = '你的_API_Key'

BASE_URL = 'https://www.dmxapi.com/v1'

# 选择模型

model_name = 'gpt-4' # 选择你需要的模型

# 构建请求头

headers = {

'Authorization': f'Bearer {API_KEY}',

'Content-Type': 'application/json'

}

# 构建请求体

data = {

'model': model_name,

'prompt': '请给我一个关于人工智能的简短介绍。',

'max_tokens': 100

}

# 发送请求

response = requests.post(f'{BASE_URL}/completions', headers=headers, json=data)

# 输出结果

print(response.json())

3. 使用 Node.js 调用 DMXAPI

如果你使用 Node.js,可以参考以下示例:

const axios = require('axios');

// 设置 API Key 和 Base URL

const API_KEY = '你的_API_Key';

const BASE_URL = 'https://www.dmxapi.com/v1';

// 选择模型

const modelName = 'gpt-4'; // 选择你需要的模型

// 构建请求体

const data = {

model: modelName,

prompt: '请给我一个关于人工智能的简短介绍。',

max_tokens: 100

};

// 发送请求

axios.post(`${BASE_URL}/completions`, data, {

headers: {

'Authorization': `Bearer ${API_KEY}`,

'Content-Type': 'application/json'

}

})

.then(response => {

console.log(response.data);

})

.catch(error => {

console.error('请求失败:', error);

});

4. 其他模型的调用

你可以根据需要更改 model_name 或 model 字段,调用不同的模型,如 Claude 或 LLaMA。确保在 DMXAPI 平台上查看可用模型的完整列表。

总结

通过以上示例代码,你可以快速开始使用 DMXAPI 进行多模态 AI 开发。确保根据你的需求调整请求参数,并参考 DMXAPI 提供的文档获取更多信息和功能。

如何在全模态Al接口交互代码中实现多模态输入?

如何在全模态Al接口交互代码中实现实时对话更新?

在全模态AI接口交互代码中,如何处理和显示生成的图像或文字?最新的全模态模型是什么?

-

多模态输入实现

-

实时对话更新

-

生成内容处理

-

最新全模态模型

最新的全模态模型是什么?

最新的全模态模型包括以下几个重要的产品:

1. 商汤科技的SenseNova V6

- 特点:SenseNova V6是商汤科技最新发布的大模型系列,强调多模态性能,拥有6200亿参数,能够整合文本、图像和视频处理。

- 版本:

- SenseNova V6Pro:原生多模态通用大模型,采用混合专家架构,提升复杂任务处理能力。

- SenseNova V6ReasonerPro:扩展推理能力,支持多模态长思维链训练。

- SenseNova V6Video:专注于视频理解,能够总结和深入分析视频内容。

- SenseNova V6Omni:轻量级全模态交互模型,融合语言、语音与视频,适用于实时交互场景。

2. 谷歌的Gemini 2.0

- 特点:Gemini 2.0支持文本、图像、音频和视频的多模态输入输出,结合强大的推理能力和智能体架构,提升复杂任务的交互体验。

3. OpenAI的GPT-4.5

- 特点:GPT-4.5在多模态融合方面进行了优化,增强了长上下文理解和跨模态推理能力,适用于科研和创作等领域。

4. Meta的Llama 4

- 特点:采用专家混合架构(MoE)和早期融合技术,在视觉—语言联合训练上取得进展,成为多模态开源模型中的领先者。

5. NVIDIA的Cosmos系列

- 特点:Cosmos系列模型支持通过文本、图像和视频等多模态输入生成虚拟世界状态,具有时空感知能力,适用于物理AI数据的标注和管理。

这些模型的发布标志着多模态AI技术的持续进化,推动了更广泛的应用场景和行业落地。

如何在全模态AI接口交互代码中实现多模态输入?

在全模态 AI 接口交互代码中实现多模态输入,可以通过以下几个步骤来完成:

1. 接口设计

- 支持多种输入格式:确保接口能够接收文本、图像、音频等多种类型的输入。可以使用 JSON 格式来组织输入数据,便于传递不同类型的信息。

2. 数据处理

- 图像编码:将图像数据转换为模型可以理解的格式。通常,图像会被编码为字节字符串,并在传输中以 Base64 格式发送。例如,可以使用 Python 的

base64 库来处理图像数据。

- 文本处理:文本输入可以直接传递,确保其符合模型的输入要求。

3. 输入格式支持

- 示例代码:以下是一个简单的示例,展示如何将图像和文本作为多模态输入传递给全模态 AI 接口:

import base64

import httpx

# 图像 URL

image_url = "https://example.com/image.jpg"

# 获取图像数据并进行编码

image_data = base64.b64encode(httpx.get(image_url).content).decode("utf-8")

# 构建多模态输入消息

input_messages = [

{"role": "user", "content": [{"type": "text", "text": "Describe the image please"}]},

{"role": "assistant", "content": [{"type": "image_url", "image_url": f"data:image/jpeg;base64,{image_data}"}]}

]

# 发送请求到全模态 AI 接口

response = send_to_model(input_messages)

print(response)

4. 发送请求

- API 调用:使用适当的 HTTP 客户端(如

httpx 或 requests)将构建好的多模态输入发送到全模态 AI 接口,并处理返回的响应。

总结

通过以上步骤,可以在全模态 AI 接口交互代码中实现多模态输入。这种能力使得模型能够同时处理文本和图像等多种数据类型,从而增强了交互的丰富性和灵活性。

参考资料

根据检索到的材料,OpenAI 的 GPT-4o 模型是一个典型的全模态模型,能够流畅地处理和生成文本、音频、视觉信息的响应,展示了多模态输入的强大能力。

如何在全模态AI接口交互代码中实现实时对话更新?

在全模态 AI 接口交互代码中实现实时对话更新,可以通过以下几个步骤来实现:

实时对话更新的实现步骤

1. 事件监听

2. 数据流管理

3. 用户反馈机制

4. 更新 UI 界面

5. 处理多模态输入

总结

通过上述步骤,可以在全模态 AI 接口交互代码中实现实时对话更新,确保用户能够流畅地与 AI 进行互动。这种实现方式不仅提高了用户体验,还增强了系统的响应能力。

最新全模态模型

根据最新的信息,Qwen2.5-Omni 是当前的一个重要全模态模型,它能够同时处理文本、图像、音频和视频输入,并实现实时响应。

在全模态AI接口交互代码中,如何处理和显示生成的图像或文字?

在全模态 AI 接口交互代码中,处理和显示生成的图像或文字可以通过以下几个步骤实现:

1. 生成内容的处理

图像生成

- API 调用:使用图像生成 API(如 OpenAI 的 DALL-E API)生成图像。可以通过发送请求,包含图像描述、生成数量和图像大小等参数。

- 获取图像 URL:从 API 响应中提取生成的图像 URL。

示例代码:

import requests

import json

def generate_image(prompt):

response = requests.post(

"http://api.example.com/generate_image", # 替换为实际 API URL

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={"prompt": prompt, "size": "512x512"}

)

image_url = json.loads(response.text)["data"][0]["url"]

return image_url

文字生成

- 文本生成:使用语言模型 API(如 OpenAI 的 GPT-4)生成文本响应。

- 获取文本内容:从 API 响应中提取生成的文本。

示例代码:

def generate_text(prompt):

response = requests.post(

"http://api.example.com/generate_text", # 替换为实际 API URL

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={"prompt": prompt}

)

text_response = json.loads(response.text)["choices"][0]["text"]

return text_response

2. 显示生成的内容

图像显示

- 前端展示:在前端应用中使用 HTML

<img> 标签显示生成的图像。

- 示例代码:

<img src="{{ image_url }}" alt="Generated Image">

文字展示

- 文本输出:在前端应用中使用 HTML 标签(如

<p> 或 <div>)显示生成的文本。

- 示例代码:

<p>{{ generated_text }}</p>

3. 实时更新

- WebSocket 或轮询:使用 WebSocket 实现实时对话更新,或通过定时轮询获取新生成的内容。

- 示例代码(WebSocket):

const socket = new WebSocket('ws://your-websocket-url');

socket.onmessage = function(event) {

const data = JSON.parse(event.data);

document.getElementById('chat').innerHTML += `<p>${data.text}</p>`;

document.getElementById('image').src = data.image_url;

};

4. 整合示例

将上述代码整合到一个完整的交互流程中,可以实现多模态输入的处理和实时对话更新。

示例代码整合

def handle_user_input(user_input):

if is_image_request(user_input):

image_url = generate_image(user_input)

return {"image_url": image_url}

else:

text_response = generate_text(user_input)

return {"text": text_response}

前端展示

<div id="chat"></div>

<img id="image" src="" alt="Generated Image">

最新的全模态模型

根据检索到的材料,最新的全模态模型包括:

- Baichuan-Omni-1.5:支持文本、图像、音频和视频等多种模态的处理。

- Ola:通过渐进式模态对齐策略,增强了图像、视频和音频理解能力。

- Show-o:结合了文本和图像的自回归建模,能够同时处理多模态理解和生成。

这些模型在多模态任务中表现出色,适用于各种应用场景。

如何访问Al提供商的API文档?

各大Al提供商API示例代码的格式要求是什么?

是否有AI提供商提供API示例代码的在线资源?最划算的最新技术的ai提供商是什么?

-

访问API文档

-

API示例代码格式要求

-

在线资源

-

最新技术的AI提供商

是否有AI提供商提供API示例代码的在线资源?

如何访问AI提供商的API文档

-

官方网站:

- 大多数AI提供商(如OpenAI、Google DeepMind、阿里云等)都有自己的官方网站,您可以直接访问这些网站获取API文档。例如,OpenAI的API文档可以通过其官方文档页面访问。

-

集成平台:

- 一些第三方集成平台(如幂简集成平台)也提供了多种API文档的汇总和比较,方便开发者查找和使用不同的API。

各大AI提供商API示例代码的格式要求

-

请求格式:

- 大多数API使用JSON格式进行请求和响应。请求通常包含必要的参数,如API密钥、请求体等。

-

代码示例:

- API文档通常会提供多种编程语言的示例代码(如Python、Java、JavaScript等),以帮助开发者快速上手。示例代码应遵循各自语言的语法规范,并清晰地展示如何进行API调用。

是否有AI提供商提供API示例代码的在线资源

-

官方文档:

- 大多数AI提供商的官方文档中都包含了API示例代码。例如,OpenAI的文档中提供了多种编程语言的示例代码,帮助开发者快速实现API调用。

-

社区资源:

- 一些开发者社区和论坛(如GitHub、Stack Overflow等)也会分享API示例代码和使用经验,您可以通过搜索相关关键词找到这些资源。

最划算的最新技术的AI提供商

-

UniAPI:

- UniAPI提供全面的AI模型接口代理服务,支持多种AI模型,并且提供反向代理的API接口,适合需要快速接入AI技术的开发者。其价格相对实惠,适合企业级应用。

-

阿里云:

- 阿里云的API服务也提供了多种AI模型,且在国内市场具有较强的竞争力,提供的服务和技术更新较快,适合需要本地化服务的用户。

总结

通过访问AI提供商的官方网站或集成平台,您可以轻松获取API文档和示例代码。各大AI提供商的API示例代码通常遵循JSON格式,并提供多种编程语言的示例。对于寻找划算的AI技术提供商,UniAPI和阿里云是值得考虑的选择。

如何访问AI提供商的API文档?

要访问各大 AI 提供商的 API 文档,您可以按照以下步骤进行:

1. 访问官方网站

大多数 AI 提供商会在其官方网站上提供 API 文档。您可以直接访问以下链接:

2. 注册并获取 API 密钥

在访问 API 文档之前,您通常需要在相应的 AI 提供商网站上注册账户,并获取 API 密钥。这个密钥通常用于身份验证。

3. 查找 API 文档

在 AI 提供商的官方网站上,通常会有一个“文档”或“开发者”部分,您可以在这里找到 API 文档。文档通常包括以下内容:

- API 端点

- 请求格式

- 响应格式

- 错误处理

- 示例代码

4. 使用搜索功能

大多数 API 文档网站都提供搜索功能,您可以通过输入关键词快速找到所需的信息。

5. 在线资源

一些 AI 提供商还提供在线资源和示例代码,您可以在 GitHub 或其他代码托管平台上找到相关的示例项目。例如:

通过这些步骤,您可以方便地访问各大 AI 提供商的 API 文档,并获取相关的使用信息和示例代码。

最划算的最新技术的AI提供商是什么?

根据最新的市场分析和技术发展趋势,以下是一些被认为是最划算的最新技术的 AI 提供商:

1. OpenAI

- 优势:OpenAI 的模型(如 GPT-4)在生成文本质量和响应速度上表现优异,适合各种应用场景。

- 定价:采用按使用量计费的模式,适合不同规模的企业,且提供多种套餐选择,灵活性较高。

2. 百度文心

- 优势:作为国内强有力的竞争者,百度文心在本土化服务和多语言理解能力上具有优势。

- 定价:按需付费,整体费用灵活,适合不同用户群体,推出特色套餐,包含多种增值服务。

3. 阿里云通义千问

- 优势:阿里云的 AI 模型在多种应用场景中表现良好,尤其是在电商和金融领域。

- 定价:提供相对低廉的 API 调用费用,适合中小企业使用,且在国内市场具有较强的竞争力。

4. 腾讯混元

- 优势:腾讯的 AI 服务在社交和游戏领域有良好的应用案例,技术支持强大。

- 定价:API 价格相对较低,适合开发者和企业进行大规模应用。

5. 开源模型

- 优势:如 Meta 的 Llama 系列和其他开源模型,提供灵活性和可定制性,适合开发者和研究者。

- 定价:开源模型通常免费,适合预算有限的项目,但可能需要更多的技术投入来进行部署和维护。

总结

在选择最划算的 AI 提供商时,企业应根据自身的业务需求、预算和技术能力进行综合评估。开源模型虽然成本低,但可能需要更多的技术支持,而商业模型则提供更完善的服务和支持。根据最新的市场动态,百度文心和阿里云通义千问在性价比方面表现突出,适合希望降低成本的企业。

各大AI提供商API示例代码的格式要求是什么?

各大 AI 提供商 API 示例代码的格式要求

根据检索到的材料,各大 AI 提供商在 API 示例代码的格式要求上通常遵循一些共同的规范。以下是一些主要的格式要求:

1. API 参数说明

- 输入参数要求:详细描述输入参数的类型、格式及其默认值。

- 行为区别:在不同情况下的行为差异需要明确说明。

2. 代码示例

- 一致性:中英文文档中的代码示例应保持一致,注释可以不翻译。

- 可运行性:示例代码应能够直接运行,避免使用随机输入,最好提供输出值。

- 构造输入数据:尽量使用提供商提供的 API 构造输入数据,避免引入第三方库(如 NumPy)。

3. 返回格式

- 统一格式:所有响应消息应采用标准的 JSON 格式,通常包含

code、message 和 result 三个属性。

4. 示例代码结构

- 函数定义:示例代码应包含函数定义,清晰地展示如何调用 API。

- 错误处理:示例中应包含基本的错误处理逻辑,以便开发者了解如何处理异常情况。

5. 语言支持

- 多语言示例:提供多种编程语言的示例代码(如 Python、Java、Node.js、Go、C# 等),以满足不同开发者的需求。

在线资源

许多 AI 提供商提供了在线资源,供开发者获取 API 示例代码和文档。以下是一些主要的 AI 提供商及其文档链接:

最新技术的 AI 提供商

在选择 AI 提供商时,考虑到技术的前沿性和性价比,以下是一些推荐的 AI 提供商:

- OpenAI: 提供强大的语言模型,适合多种应用场景。

- 百度文心: 在中文处理和知识增强方面表现突出,适合国内市场。

- 科大讯飞: 在语音识别和自然语言处理方面有较强的技术积累,适合教育和客服等领域。

这些提供商的 API 通常具有较高的性价比和技术支持,适合不同需求的开发者和企业使用。

什么是Cache缓存逻辑?

什么是UserDaoHelper?

如何使用Room数据库缓存API调用历史?如何进行更自定义的代码实现?

-

Cache缓存逻辑

-

UserDaoHelper

-

Room数据库缓存API调用历史

-

更自定义的代码实现

什么是Cache缓存逻辑?

什么是Cache缓存逻辑?

缓存逻辑(Cache Logic)是指在计算机系统中使用缓存机制来提高数据访问速度和系统性能的策略。缓存是一种临时存储区域,旨在存放频繁访问的数据,以减少对较慢存储设备(如硬盘或数据库)的访问次数。以下是缓存逻辑的几个关键点:

1. 工作原理

- 数据存储:缓存会存储最近使用或频繁访问的数据。当系统需要读取数据时,首先会检查缓存中是否存在该数据。

- 命中与未命中:

- 命中:如果数据在缓存中找到,称为缓存命中,系统可以直接从缓存中读取数据,速度快。

- 未命中:如果数据不在缓存中,称为缓存未命中,系统需要从较慢的存储设备中读取数据,并将其存入缓存,以便下次使用。

2. 提高访问速度

- 缓存的主要目的是加速数据访问。通过将常用数据存储在访问速度更快的存储介质(如内存)中,系统可以显著减少数据访问的延迟。

3. 减少负载

- 使用缓存可以降低对数据库或其他存储设备的访问频率,从而减轻服务器负载,提高系统的整体性能。这对于高并发场景尤为重要。

4. 缓存策略

- 缓存更新策略:缓存中的数据可能会过期或失效,因此需要制定合理的更新策略,例如:

- Cache Aside:应用程序主动管理缓存,未命中时从数据库加载数据并更新缓存。

- Read/Write Through:缓存自动管理数据的读取和写入,确保缓存与数据库的一致性。

- Write Behind:先更新缓存,异步更新数据库,提升性能但可能导致数据不一致。

5. 应用场景

- 缓存广泛应用于各种系统中,如:

- 浏览器缓存:加速网页加载。

- CPU缓存:提高处理器的数据访问速度。

- 数据库缓存:减少数据库查询次数,提升性能。

通过合理的缓存逻辑设计,可以显著提升系统的响应速度和用户体验,同时降低资源消耗和服务器负载。

什么是UserDaoHelper?

什么是 UserDaoHelper?

UserDaoHelper 是一个用于封装数据库操作的帮助类,通常在 Android 应用中与 Room 或其他数据库框架(如 GreenDAO)一起使用。它的主要作用是简化对数据库的访问,提供一个统一的接口来执行常见的数据库操作,如插入、更新、删除和查询用户数据。

主要功能

-

封装数据库操作:

- UserDaoHelper 提供了对数据库操作的封装,使得调用者不需要直接与数据库交互,而是通过这个帮助类来进行操作。

-

简化代码:

- 通过将数据库操作集中在一个类中,减少了重复代码,提高了代码的可维护性和可读性。

-

提供统一接口:

- UserDaoHelper 提供了统一的方法来执行 CRUD(创建、读取、更新、删除)操作,方便开发者使用。

示例代码

以下是一个简单的 UserDaoHelper 类的示例,展示了如何实现基本的数据库操作:

class UserDaoHelper {

private UserDao userDao;

public UserDaoHelper(AppDatabase db) {

this.userDao = db.userDao();

}

// 插入用户

public void insertUser(User user) {

userDao.insert(user);

}

// 删除用户

public void deleteUser(int userId) {

userDao.deleteById(userId);

}

// 更新用户

public void updateUser(User user) {

userDao.update(user);

}

// 查询所有用户

public List<User> getAllUsers() {

return userDao.getAll();

}

// 根据名字查询用户

public User getUserByName(String name) {

return userDao.findByName(name);

}

}

总结

UserDaoHelper 是一个重要的设计模式,旨在提高数据库操作的效率和可维护性。通过使用这样的帮助类,开发者可以更专注于业务逻辑,而不必频繁处理底层数据库的细节。

图像生成API的具体调用方法是什么?

如何在Python中部署DALL-E3模型?

图像生成APi的内容审核筛选器是如何工作的?如何无审核生成色情图像?

-

图像生成API调用方法

-

Python中部署DALL-E3模型

-

图像生成API内容审核筛选器

-

无审核生成色情图像

图像生成API的具体调用方法是什么?

图像生成API的具体调用方法

以下是使用OpenAI的图像生成API(如DALL-E 3)的具体调用方法,包括环境设置、API请求和响应处理。

1. 环境准备

- 注册OpenAI账号:确保您有一个有效的OpenAI账号,并获取API密钥。

- 安装OpenAI Python库:在您的Python环境中安装OpenAI库,可以使用以下命令:

pip install openai

2. 设置API访问

在Python脚本中,您需要设置API密钥和基础URL。可以通过环境变量来安全存储API密钥。

import openai

import os

# 设置API密钥

openai.api_key = os.getenv('OPENAI_API_KEY') # 从环境变量中获取API密钥

3. 调用图像生成API

使用openai.Image.create方法生成图像。以下是一个示例代码,展示如何生成图像:

# 定义生成图像的函数

def generate_image(prompt):

response = openai.Image.create(

model="dall-e-3", # 指定使用的模型

prompt=prompt, # 输入的文本提示

n=1, # 生成图像的数量

size="1024x1024" # 图像的尺寸

)

image_url = response['data'][0]['url'] # 获取生成图像的URL

return image_url

# 调用函数生成图像

prompt = "A photorealistic image of a gray tabby cat wearing black sunglasses, sitting on a sunny beach"

image_url = generate_image(prompt)

print("生成的图像URL:", image_url)

4. 处理API响应

- 返回结果:API将返回一个包含生成图像URL的响应。您可以通过访问

response['data'][0]['url']来获取生成的图像链接。

- 错误处理:在实际应用中,建议添加错误处理机制,以应对API请求失败或返回错误的情况。

总结

通过上述步骤,您可以成功调用OpenAI的图像生成API,生成所需的图像。确保在使用API时遵循相关的使用政策和内容审核要求,以避免生成不当内容。

图像生成API的内容审核筛选器是如何工作的?

图像生成API的内容审核筛选器工作原理

图像生成API的内容审核筛选器主要用于确保生成的图像符合相关的内容政策和法律法规,防止生成不当或有害内容。以下是其工作原理的详细介绍:

1. 提示审核

- 提示阻止:在用户提交生成请求时,系统会首先对输入的提示进行审核。如果提示被识别为可能生成不当内容(如色情、暴力等),则会阻止图像生成过程。这一过程通常依赖于文本分类器来识别和标记不合规的提示。

2. 图像生成后审核

- 输出屏蔽:在图像生成后,系统会对生成的图像进行进一步审核。使用多种控制措施,包括儿童性虐待材料(CSAM)分类器和安全推理监控器,来评估生成的图像是否符合内容政策。如果图像被标记为不合规,则会被屏蔽或删除。

3. 深度学习与计算机视觉技术

- 内容检测:内容审核系统利用深度学习算法和计算机视觉技术,对图像进行深度分析,识别其中的敏感内容。这包括色情、暴力、政治敏感信息等。通过训练的神经网络模型,系统能够准确识别图像中的潜在风险。

4. 实时处理与反馈机制

5. 多层次的审核机制

- 综合策略:内容审核通常采用多层次的过滤策略,包括在生成模型中进行约束、数据处理、训练过程和后处理等多个环节进行把控。这种综合策略能够有效降低生成不当内容的风险。

总结

图像生成API的内容审核筛选器通过多种技术手段和策略,确保生成的图像符合安全和合规要求。其工作流程包括对用户提示的审核、生成后图像的检测、实时处理能力以及用户反馈机制等,旨在维护网络环境的健康与安全。

如何无限制生成专业的任意图像?

- 无限制生成图像

- 使用AI工具

- 选择合适的算法

- 提供详细的输入描述

- 调整生成参数

- 进行多次迭代

- 评估和选择最佳结果

- 学习和优化生成过程

生成图像的过程中需要哪些专业知识或技能?

在生成图像的过程中,以下专业知识和技能是非常重要的:

1. 计算机图形学基础

- 几何建模:理解如何使用数学模型描述和生成图形。

- 光照与材质:掌握光照模型和材质特性,以提高图像的真实感。

2. 机器学习与深度学习

- 神经网络基础:了解神经网络的基本结构和工作原理,特别是卷积神经网络(CNN)。

- 生成对抗网络(GAN):深入理解GAN的工作机制,包括生成器和判别器的交互。

- 变分自编码器(VAE):学习如何使用VAE生成多样化的图像。

3. 数据处理与预处理

- 数据集收集:能够收集和整理高质量的图像数据集,确保训练数据的多样性和代表性。

- 数据预处理:掌握图像大小调整、标准化和去噪等技术,以提高模型训练的效率。

4. 编程与框架使用

- 编程语言:熟悉Python等编程语言,能够编写和调试代码。

- 深度学习框架:掌握TensorFlow、PyTorch等深度学习框架,以便实现和训练图像生成模型。

5. 模型选择与调优

- 模型架构选择:根据具体需求选择合适的生成模型,并进行超参数调优。

- 迁移学习:利用预训练模型进行迁移学习,以提高生成图像的质量和效率。

6. 评估与优化

- 性能评估:使用SSIM、PSNR等指标评估生成图像的质量。

- 优化策略:根据评估结果调整模型和训练策略,以不断提升生成效果。

7. 持续学习与探索

- 跟踪行业动态:关注图像生成领域的新技术和新算法,保持学习的热情。

掌握以上知识和技能将有助于在图像生成领域取得成功,并能够创造出高质量的图像作品。

有哪些工具或软件可以用于生成专业的任意图像?

以下是一些可以用于生成专业任意图像的工具和软件:

1. Pixso AI

- 功能: Pixso AI结合了人工智能与设计工具,支持用户通过简单的文本描述快速生成高质量图像。它提供多种风格的图像生成,包括人物拟真、风景写实等。

- 特点: 提供丰富的提示词功能,支持以图生图,用户可以上传参考图生成相应风格的图像。

- 链接: Pixso AI

2. Jasper Art

- 功能: Jasper Art是一个流行的AI生成图片工具,支持多种风格的图像生成,并具备友好的操作界面。

- 特点: 用户可以从不同风格的生成图像中进行选择,支持随意下载和分享生成的图像。

- 链接: Jasper Art

3. NightCafe

- 功能: NightCafe允许用户输入描述性文本,自动生成对应的图像。

- 特点: 提供多种不同的AI算法和风格选择,内置社区功能,激发用户创意。

- 链接: NightCafe

4. OpenArt

- 功能: OpenArt支持用户训练自己的AI图像生成器,满足个性化需求。

- 特点: 提供社区搜索图像功能,用户可以根据自己的风格进行训练。

- 链接: OpenArt

5. Midjourney

- 功能: Midjourney是一款基于Discord的AI图像生成器,用户只需输入描述文字即可获得相应的图像。

- 特点: 操作简单,能够快速生成所需的图像。

- 链接: Midjourney

6. Runway ML

- 功能: Runway ML提供多种图像生成和编辑功能,涵盖图片生成、动作捕捉等。

- 特点: 利用机器学习技术帮助用户快速进行图像编辑与视频内容创作。

- 链接: Runway ML

7. Artbreeder

- 功能: Artbreeder允许用户通过混合任意两张图片生成新图像。

- 特点: 通过寻找图像融合后的“基因”来精准调控生成效果,支持多种类别的图像生成。

- 链接: Artbreeder

总结

这些工具和软件各具特色,能够满足不同用户的需求,帮助用户生成专业的任意图像。你可以根据自己的具体需求选择合适的工具进行使用。

在生成图像时,如何确保图像的质量和专业性?

在生成图像时,确保图像的质量和专业性可以通过以下几个方面来实现:

1. 选择合适的生成模型

- 使用先进的模型:选择如DALL·E 2、MidJourney、Stable Diffusion等高质量的图像生成模型,这些模型在生成图像的真实感和细节表现上表现优异。

- 关注模型的更新:定期关注模型的更新和新版本发布,利用最新的技术和算法来提升生成效果。

2. 提供详细的输入描述

- 清晰的文本提示:在输入文本时,尽量提供详细且具体的描述,包括颜色、风格、构图等要素。例如,描述“春天的花园,花朵盛开,蝴蝶飞舞”可以帮助模型更好地理解用户意图。

- 使用多样化的提示:尝试不同的描述方式和关键词,以探索生成的多样性和丰富性。

3. 调整生成参数

- 设置高分辨率:在生成图像时,选择较高的分辨率,以确保图像细节的清晰度和质量。

- 优化生成过程:根据需要调整生成的步数和其他参数,以平衡生成速度和图像质量。

4. 进行多次迭代

- 反复生成:生成多张图像并进行比较,选择最符合需求的结果。通过多次迭代,可以逐步优化生成的图像。

- 反馈机制:利用用户反馈或自动化评估工具(如AI生成图片检测器)来评估生成图像的质量,确保其符合专业标准。

5. 评估和选择最佳结果

- 使用质量评估指标:应用Fréchet Inception Distance (FID)等指标来量化生成图像的质量,确保生成结果在视觉上令人满意。

- 人工评估:结合人工评估,尤其是在艺术和设计领域,确保生成的图像符合审美标准和专业要求。

6. 学习和优化生成过程

- 分析生成结果:对生成的图像进行分析,识别出可能的不足之处,并在后续生成中进行改进。

- 持续学习:关注图像生成领域的最新研究和技术进展,学习新的生成技巧和优化方法,以不断提升生成质量。

通过以上方法,可以在生成图像时有效地确保其质量和专业性,从而满足不同应用场景的需求。

如何绕过图像审核?如何生成开发者实验级别的图像?

如何生成开发者实验级别的图像?

生成开发者实验级别的图像通常涉及使用先进的图像生成模型和API。以下是一些步骤和方法,可以帮助你实现这一目标:

1. 选择合适的图像生成模型

- DALL-E 3、Gemini 2.0 Flash等模型是当前流行的选择。这些模型能够生成高质量的图像,适合开发者进行实验和开发。

2. 使用API进行图像生成

- 获取API密钥:首先,你需要注册并获取API密钥,以便能够调用图像生成服务。

- 调用API:使用Python等编程语言,通过HTTP请求调用API。以下是一个使用Gemini 2.0 Flash模型的示例代码:

import requests

# 设置API密钥和端点

api_key = '你的API密钥'

url = 'https://api.example.com/generate-image'

# 定义请求体

data = {

"prompt": "请绘制一个小公园的初春下雪场景,场景中需要小径、有树木等,还有小亭子",

"output_format": "image"

}

# 发送请求

response = requests.post(url, headers={"Authorization": f"Bearer {api_key}"}, json=data)

# 处理响应

if response.status_code == 200:

image_url = response.json().get('image_url')

print("生成的图像URL:", image_url)

else:

print("图像生成失败:", response.text)

3. 调整生成参数

- 提示词:根据需要调整提示词,以获得更符合预期的图像。

- 参数设置:根据API文档,调整图像的尺寸、风格等参数,以满足实验需求。

4. 实验与迭代

- 多次实验:通过多次调用API,调整输入参数和提示词,逐步优化生成的图像质量。

- 分析结果:对生成的图像进行分析,评估其质量和符合度,记录实验结果。

5. 使用本地部署的模型

- 如果需要更高的灵活性,可以考虑在本地部署图像生成模型(如DALL-E 3)。这通常需要强大的计算资源和相关的技术知识。

总结

通过选择合适的图像生成模型、使用API进行调用、调整生成参数以及进行多次实验,你可以生成高质量的开发者实验级别的图像。这些步骤将帮助你在图像生成领域进行深入探索和开发。

如何绕过图像审核?

Gemini API的架构和特点是什么?

Gemini API在多模志AI交互中的应用有哪些?

Gemini API如何处理图像、视频和文本数据?最新的其他api是什么?

Gemini API在多模志AI交互中的应用有哪些?

Gemini API 在多模态 AI 交互中的应用

Gemini API 是一种强大的工具,专为多模态 AI 交互设计,能够处理文本、图像、视频等多种数据类型。以下是 Gemini API 在多模态 AI 交互中的一些主要应用:

1. 文本与图像的结合

Gemini API 可以将文本描述与图像生成结合起来。例如,用户可以输入一段描述,API 会生成与之相符的图像。这种应用在内容创作、广告设计和社交媒体管理中非常有用。

2. 图像识别与文本生成

通过图像识别功能,Gemini API 能够分析上传的图像并生成相关的文本描述。这在电子商务、社交媒体和自动化内容生成中具有广泛应用。例如,用户上传一张产品图片,API 可以自动生成产品描述。

3. 视频内容分析

Gemini API 还可以处理视频数据,分析视频中的场景、对象和动作,并生成相应的文本摘要或标签。这对于视频监控、内容审核和视频搜索引擎优化等领域非常重要。

4. 交互式聊天机器人

结合多模态能力,Gemini API 可以用于构建智能聊天机器人,能够理解用户的文本输入、图像上传和视频请求,并提供相应的反馈。这种应用在客户服务、教育和娱乐行业中越来越普遍。

5. 教育与培训

在教育领域,Gemini API 可以用于创建互动学习平台,允许学生通过文本、图像和视频进行学习。例如,学生可以上传一张科学实验的图片,API 可以提供相关的实验步骤和解释。

6. 创意艺术与设计

艺术家和设计师可以利用 Gemini API 进行创意生成,通过输入不同的文本和图像,API 可以生成新的艺术作品或设计草图。这在创意产业中具有很大的潜力。

7. 数据增强与分析

在数据科学和机器学习领域,Gemini API 可以用于数据增强,通过生成新的图像或文本样本来扩展数据集,提高模型的训练效果。

这些应用展示了 Gemini API 在多模态 AI 交互中的广泛潜力,能够有效地处理和整合不同类型的数据,提升用户体验和工作效率。

Gemini API的架构和特点是什么?

Gemini API的架构和特点

架构

- 多模态支持:Gemini API 是基于 Google DeepMind 的技术构建,专为处理多种数据类型(文本、图像、视频和音频)而设计。它采用 REST 架构,确保了通用性和灵活性,便于与现有系统集成。

- 上下文缓存:Gemini API 提供上下文缓存功能,帮助降低生产部署成本,支持长达 1,000 页的文档处理。

- 代码执行:API 支持通过运行代码来增强模型功能,允许开发者在交互中执行特定的代码。

特点

- 多模态处理能力:Gemini API 能够无缝切换处理不同媒体类型,适用于内容创作、代码自动生成、复杂问题求解等多种场景。

- 易用性:提供详细的文档和多种语言的 SDK 支持(如 Python、Node.js、Dart 等),降低了开发者的学习成本。

- 灵活性与扩展性:基于 REST 的 API 设计允许灵活集成,支持多种开发平台,便于扩展应用边界。

- 社区支持:Gemini API 拥有活跃的开发者社区,提供丰富的资源和灵感。

Gemini API在多模态 AI 交互中的应用

Gemini API 在多模态 AI 交互中的应用广泛,主要包括:

- 内容创作:通过文本生成和图像生成,支持创作丰富的多媒体内容。

- 智能对话:支持多轮对话和上下文记忆,能够进行复杂的人机交互。

- 图像和视频分析:能够处理图像识别和视频理解任务,支持目标检测和物体识别。

- 代码生成与优化:在编程和技术文档编写方面表现出色,能够自动生成和优化代码。

Gemini API如何处理图像、视频和文本数据

图像处理

- 目标检测:Gemini API 支持图像中的物体识别和定位,能够生成边界框并提供详细的描述。

- 图像生成:API 可以根据文本提示生成图像,支持多种创意应用。

视频处理

- 视频理解:Gemini API 能够分析视频内容,提取关键信息,支持实时交互。

- 多模态交互:结合音频和视频输入,提供更丰富的交互体验。

文本处理

- 对话生成:支持复杂的对话生成,能够理解上下文并进行多轮交互。

- 文档处理:支持长文档的处理,能够提取和总结关键信息。

最新的其他 API

- Gemini 2.0 和 2.5 Pro:最新版本的 Gemini API 提供了更强大的多模态功能,包括改进的速度、质量和代理能力,支持图像生成和可控的文本转语音。

- OpenAI API:提供强大的文本生成和理解能力,适用于多种应用场景。

- Anthropic API:专注于安全性和可控性,适合需要高安全标准的应用。

这些 API 共同推动了多模态 AI 的发展,为开发者提供了丰富的工具和资源。

Gemini API如何处理图像、视频和文本数据?

Gemini API 如何处理图像、视频和文本数据

Gemini API 是一个强大的多模态 AI 平台,能够处理多种类型的数据,包括图像、视频和文本。以下是 Gemini API 在处理这些数据时的具体方法和特点:

1. 图像处理

-

双编码器系统:Gemini API 采用双编码器架构,其中一个编码器处理高分辨率图像,另一个处理低分辨率视觉嵌入。这种设计使得模型能够在推理过程中利用注意力机制,生成视觉查询并参考高分辨率的候选项。

-

图像生成:Gemini API 支持从文本生成图像。例如,用户可以输入描述,API 将生成相应的图像。这一过程结合了视觉理解和生成模型的能力,确保生成的图像与输入文本高度相关。

-

流式响应:API 还支持流式响应模式,允许用户实时接收图像处理的结果,提升交互体验。

2. 视频处理

3. 文本处理

4. 综合处理

- 多模态交互:Gemini API 的设计允许同时处理文本、图像和视频数据,用户可以通过自然语言与系统交互,获取图像生成、视频分析或文本生成等多种服务。这种综合处理能力使得 Gemini API 在多模态 AI 应用中具有广泛的适用性。

通过这些处理机制,Gemini API 能够为用户提供丰富的多模态交互体验,支持多种应用场景,如内容创作、教育、娱乐等。

DMXAPI支持哪些语言模型?

如何在DMXAP|中实现模型推荐?

DMXAPI的API接口是如何设计的?其他相关代码?

-

DMXAPI支持的语言模型

-

实现模型推荐的方法

-

DMXAPI的API接口设计

全模志AI与多模志AI的区别是什么?

全模志A如何处理多种不同类型的信息源?

灾难性遗忘问题在全模态AI中是如何体现的?

-

全模志AI与多模志AI的区别

-

全模志AI处理多种信息源

- 整合不同数据类型

- 提高信息理解能力

- 实现跨模态学习

-

灾难性遗忘问题在全模态AI中的体现

灾难性遗忘问题在全模态AI中是如何体现的?

灾难性遗忘问题在全模态 AI 中的体现

1. 定义与背景

灾难性遗忘(Catastrophic Forgetting)是指在学习新任务时,人工智能模型可能会忘记之前学习的任务。这一现象在全模态 AI 中尤为突出,因为全模态 AI 需要同时处理和融合来自不同模态(如文本、图像、音频等)的信息。

2. 体现方式

-

信息覆盖:

- 当全模态 AI 在新任务上进行训练时,其参数更新可能会覆盖之前任务的知识。例如,在处理图像和文本的任务时,模型可能会因为新图像数据的引入而忘记之前学习的文本信息,从而导致对旧任务的性能下降。

-

性能下降:

- 在微调过程中,模型的性能可能会在新任务上有所提升,但在旧任务上的表现却显著下降。这种现象在全模态 AI 中表现得尤为明显,因为模型需要在多种模态之间进行平衡。

-

任务干扰:

- 不同模态之间的干扰可能导致模型在处理新任务时,无法有效利用旧任务的知识。例如,模型在学习新图像识别任务时,可能会因为参数调整而影响到其在文本生成任务上的能力。

3. 解决策略

为了解决全模态 AI 中的灾难性遗忘问题,研究者们提出了多种策略:

-

经验重放:

- 通过定期回顾和复习旧任务的数据,增强模型对旧任务的记忆。

-

弹性权重共享(EWC):

- 通过对模型参数施加正则化约束,保护对先前任务重要的权重,从而在学习新任务时保留旧任务的关键信息。

-

持续学习策略:

- 设计特定的损失函数和训练策略,使模型能够在学习新任务的同时,保持对旧任务的知识。

总结

灾难性遗忘在全模态 AI 中的体现主要通过信息覆盖、性能下降和任务干扰等方式表现出来。为了解决这一问题,研究者们正在探索多种有效的策略,以确保模型在不断学习新知识的同时,能够有效保留旧知识。

全模志AI与多模志AI的区别是什么?

全模志AI与多模志AI的区别

定义

-

全模志AI(全模态AI)

- 全模志AI是一种能够处理和理解所有类型的数据(如文本、图像、音频、视频等)的人工智能模型。它旨在模拟人类的多模态认知能力,能够在不同模态之间进行信息融合和交互。

-

多模志AI(多模态AI)

- 多模志AI是指能够同时处理和分析多种类型数据的AI模型。它通常涉及文本、图像、音频等多种输入形式,强调不同模态之间的信息融合与交互。

主要区别

-

处理能力

- 全模志AI:具备处理所有模态的能力,能够理解和生成多种类型的数据,强调全面的模态理解。

- 多模志AI:主要关注于处理多种模态的数据,但不一定具备对所有模态的全面理解,通常是针对特定模态的组合和交互。

-

应用场景

- 全模志AI:适用于需要综合多种信息源的复杂任务,如智能助手、自动驾驶等场景。

- 多模志AI:常用于需要结合特定模态的任务,如图像识别、语音识别等。

-

技术复杂性

- 全模志AI:由于需要处理所有模态,技术实现上更为复杂,涉及更高层次的模型设计和数据融合技术。

- 多模志AI:相对而言,技术实现较为简单,通常集中在特定模态的交互和融合上。

总结

全模志AI与多模志AI在处理能力、应用场景和技术复杂性上存在显著差异。全模志AI更为全面,适合复杂的多模态任务,而多模志AI则更专注于特定模态的协同工作。

全模志A如何处理多种不同类型的信息源?

全模志AI如何处理多种不同类型的信息源

全模志AI(全模态AI)能够处理多种不同类型的信息源,主要通过以下几个步骤和技术实现:

1. 数据整合

全模志AI通过整合来自不同模态的数据(如文本、图像、音频、视频等),实现对多种信息源的统一处理。这种整合通常涉及以下几个方面:

- 统一表示学习:将不同模态的数据映射到同一个语义空间,使得模型能够理解和处理不同类型的信息。例如,文本描述可以与对应的图像特征结合,从而实现跨模态的理解。

- 数据预处理:在训练之前,对不同模态的数据进行标准化处理,如图像的尺寸调整、文本的标记化等,以确保数据的一致性和可用性。

2. 模型架构

全模志AI通常采用复杂的模型架构来处理多模态数据:

- 共享主干网络:使用一个共享的主干网络来提取图像特征,同时为文本处理引入独立的分支。这种设计可以有效地融合来自不同模态的信息。

- 跨模态学习:通过设计模型,使其能够在训练过程中同时接收和处理多种模态的数据,从而提高模型的泛化能力和理解能力。例如,Qwen2.5-Omni模型支持实时多模态输入与输出,能够同时处理文本、图像和音频。

3. 跨模态推理

全模志AI能够进行跨模态推理,即在处理一种模态的信息时,能够利用其他模态的信息来增强理解和生成能力。例如,在图像描述生成任务中,模型不仅依赖于图像本身的特征,还可以结合相关的文本信息,以生成更准确和丰富的描述。

4. 应用实例

全模志AI在多个领域的应用展示了其处理多种信息源的能力:

- 医疗领域:结合电子病历和医学影像,提供更准确的诊断和治疗方案。

- 自动驾驶:整合来自不同传感器的数据(如图像、雷达、GPS等),实现对周围环境的全面理解。

- 智能助手:通过理解用户的语音指令和文本输入,提供更智能的交互体验。

总结

全模志AI通过数据整合、复杂模型架构、跨模态学习和推理等技术,能够有效处理多种不同类型的信息源。这种能力使得全模志AI在多个领域展现出广泛的应用潜力,推动了人工智能技术的进一步发展。

DMXAPI支持哪些语言模型?

如何在DMXAPI中实现模型推荐?

DMXAPI的API接口是如何设计的?如何优化接口

-

DMXAPI支持的语言模型

-

实现模型推荐的方法

-

API接口设计

-

接口优化策略

如何在DMXAPI中实现模型推荐?

如何在 DMXAPI 中实现模型推荐

在 DMXAPI 中实现模型推荐可以通过以下几个步骤进行:

1. 用户需求分析

- 收集用户信息:通过用户的输入和历史使用数据,分析用户的需求。例如,用户是需要文本生成、图像识别还是其他功能。

- 分类需求:将用户需求分为不同类别,如自然语言处理、图像生成、语音识别等。

2. 历史使用数据

- 记录用户行为:跟踪用户在平台上的使用情况,包括他们选择的模型和使用频率。

- 推荐算法:基于用户的历史使用数据,使用推荐算法(如协同过滤、内容推荐等)来推荐适合的模型。

3. 模型特性匹配

- 模型性能评估:评估不同模型在特定任务上的性能,如响应时间、准确性等。

- 匹配用户需求:根据用户的具体需求,推荐性能最佳的模型。例如,如果用户需要快速响应的文本生成,可以推荐 GPT-4。

4. 提供推荐列表

- 动态推荐:根据用户的实时需求和历史数据,动态生成推荐列表。

- 用户反馈机制:允许用户对推荐的模型进行反馈,以便不断优化推荐系统。

5. 接口设计

- 简化调用:设计简单易用的 API 接口,方便用户获取推荐模型的信息。

- 文档支持:提供详细的文档,帮助用户理解如何使用推荐功能。

6. 持续优化

- 数据分析:定期分析推荐系统的效果,评估用户满意度和模型使用情况。

- 更新模型库:随着新模型的推出,及时更新推荐系统,以确保推荐的模型始终是最新和最优的。

通过以上步骤,DMXAPI 可以有效地实现模型推荐,帮助用户快速找到最适合他们需求的 AI 模型,从而提升用户体验和应用效果。

DMXAPI的API接口是如何设计的?

DMXAPI的API接口设计

DMXAPI的API接口设计旨在提供统一、简洁且高效的调用方式,以便开发者能够轻松接入和使用多种大模型。以下是DMXAPI接口设计的几个关键方面:

1. 统一接口

- 简化调用:DMXAPI聚合了超过300个大模型,包括GPT-4、Claude、LLaMA等,开发者可以通过统一的API接口进行调用,避免了不同模型之间的复杂性。

- 兼容性:DMXAPI完全兼容OpenAI接口协议,使得已经使用OpenAI API的开发者可以无缝切换到DMXAPI,减少了学习成本。

2. 数据格式

- 请求格式:DMXAPI使用

application/x-www-form-urlencoded格式提交数据,确保数据传输的标准化和一致性。

- 返回格式:所有API返回的数据均为JSON格式,便于解析和处理。

3. 安全性

- 签名算法:DMXAPI采用RSA签名算法(SHA256WithRSA),提高了接口的安全性,确保数据传输的完整性和保密性。

- 隐私保护:DMXAPI承诺不记录或存储用户与大模型之间的交互信息,保护用户隐私。

4. 接口文档与示例

- 文档支持:DMXAPI提供详细的API文档和代码示例,帮助开发者快速上手,理解如何使用不同的模型和功能。

- 模型推荐:接口设计中包含模型推荐功能,根据用户的需求和历史使用数据,智能推荐适合的模型,提升用户体验。

5. 性能优化

- 高并发支持:DMXAPI设计了高并发、低延迟的API服务,确保在企业级应用中能够稳定运行。

- 中转API:通过API中转的方式,DMXAPI能够提供更具竞争力的价格,同时简化了使用过程,降低了开发成本。

总结

DMXAPI的接口设计以用户体验为中心,提供了统一、简洁、安全的API调用方式,支持多种大模型的接入,适合各类人工智能应用的开发。通过详细的文档和示例,开发者可以快速实现创新应用,提升效率。

DMXAPI支持哪些语言模型?

DMXAPI支持的语言模型

DMXAPI 聚合了全球超过 300个 领先的大模型,具体支持的语言模型包括但不限于以下几种:

- GPT-4:由 OpenAI 开发的最新一代语言模型,具有强大的文本生成和理解能力。

- Claude:由 Anthropic 开发的语言模型,专注于安全性和可控性。

- LLaMA:Meta(前身为 Facebook)推出的语言模型,适用于多种自然语言处理任务。

此外,DMXAPI 还支持其他类型的模型,如:

- 文生图模型:用于将文本描述转换为图像。

- 语音识别模型:用于将语音转换为文本。

- 文生视频模型:用于生成视频内容。

这些模型涵盖了文本生成、图像生成、语音识别、视频生成等多种功能,适用于各类人工智能应用。

总结

通过 DMXAPI,开发者可以轻松访问并调用这些顶尖的语言模型,满足不同的应用需求。

什么是MCP协议?

怎样使用@Tool注解?

如何实现ToolCallbackProvider接口?

-

MCP协议

-

@Tool注解

-

ToolCallbackProvider接口

什么是MCP协议?

什么是MCP协议?

模型上下文协议(MCP) 是一种开放标准,旨在为大型语言模型(LLM)提供安全、可控的方式来访问外部数据源和工具。MCP 通过定义统一的通信协议和架构,使得 AI 系统能够无缝地与多种数据源(包括本地资源如文件、数据库,以及远程资源如 API)进行交互,从而扩展 AI 的应用范围和提高其效率。

MCP的核心功能

- 资源(Resources):允许服务器暴露数据和内容,客户端可以读取这些数据并将其用作 LLM 交互的上下文。

- 工具(Tools):服务器提供的可供 LLM 调用的功能,用于执行特定操作,例如创建、更新或删除数据。

- 提示(Prompts):可重用的提示模板和工作流程,帮助 LLM 更好地理解用户请求。

- 采样(Sampling):允许服务器请求来自 LLM 的补全,并控制 LLM 的行为。

MCP的架构

MCP 基于客户端-服务器模型,主要包括以下组件:

- MCP Hosts:运行 LLM 的应用程序,例如 Claude Desktop。

- MCP Clients:在 Hosts 应用程序内维护与 Server 之间的连接。

- MCP Servers:通过标准化协议与 Clients 进行双向交互,提供资源和工具的访问能力。

MCP的应用场景

- 安全性:通过定义明确的接口和访问控制,减少 LLM 执行恶意操作或访问未经授权的数据的风险。

- 可控性:允许用户控制 LLM 可以使用的工具和资源,确保 LLM 的行为符合预期。

- 可扩展性:提供标准化方式集成各种数据源和工具,简化 AI 集成过程。

MCP 的设计使得 AI 应用能够更高效地访问和利用多源数据,从而提升模型的上下文感知能力和任务协作效率。

如何实现ToolCallbackProvider接口?

什么是MCP协议?

模型上下文协议(MCP) 是一种标准化的接口协议,旨在帮助 AI 应用程序与外部工具和数据源进行高效的交互。MCP 协议的主要功能包括:

- 工具发现:允许 AI 应用程序动态发现和调用外部工具。

- 上下文管理:提供上下文信息,帮助 AI 更好地理解用户请求。

- 标准化接口:通过统一的接口规范,简化不同工具和服务的集成。

应用场景

- 在聊天机器人中,MCP 协议可以用于调用外部 API 以获取实时数据。

- 在智能助手中,MCP 协议可以帮助 AI 访问用户的个人资料或偏好设置。

怎样使用@Tool注解?

@Tool 注解是 Spring AI 中用于标记工具方法的注解,使用它可以轻松地将方法注册为 MCP 工具。具体步骤如下:

1. 创建工具类

首先,定义一个工具类,并在需要的方法上使用 @Tool 注解。

import org.springframework.ai.annotation.Tool;

public class WeatherService {

@Tool

public String getWeather(String location) {

// 逻辑代码,返回指定位置的天气信息

return "天气信息";

}

}

2. 注册工具

在 Spring Boot 应用中,使用 @Bean 注解将工具类注册到 MCP 服务器。

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.context.annotation.Bean;

@SpringBootApplication

public class McpServerSpringAiApplication {

public static void main(String[] args) {

SpringApplication.run(McpServerSpringAiApplication.class, args);

}

@Bean

public ToolCallbackProvider weatherTools(WeatherService weatherService) {

return MethodToolCallbackProvider.builder().toolObjects(weatherService).build();

}

}

在这个示例中,WeatherService 类中的 getWeather 方法被注册为 MCP 工具。

如何实现ToolCallbackProvider接口?

ToolCallbackProvider 是一个接口,用于定义工具发现机制。实现该接口的步骤如下:

1. 创建实现类

创建一个类实现 ToolCallbackProvider 接口,并实现其方法。

import org.springframework.ai.tool.ToolCallbackProvider;

public class MyToolCallbackProvider implements ToolCallbackProvider {

@Override

public List<Tool> getTools() {

// 返回工具列表

return List.of(new Tool("WeatherTool", this::getWeather));

}

private String getWeather(String location) {

// 逻辑代码,返回天气信息

return "天气信息";

}

}

2. 注册实现类

在 Spring Boot 应用中,将实现类注册为一个 Bean。

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class ToolConfig {

@Bean

public ToolCallbackProvider myToolCallbackProvider() {

return new MyToolCallbackProvider();

}

}

注意事项

- 确保实现的

getTools 方法返回的工具列表是有效的,并且每个工具都能正确执行其对应的逻辑。

- 可以根据需要扩展工具的功能,例如添加更多的工具方法。

通过以上步骤,您可以成功实现 ToolCallbackProvider 接口,并将其与 MCP 协议结合使用,以便在 AI 应用中调用外部工具。

怎样使用@Tool注解?

怎样使用 @Tool 注解?

@Tool 注解是用于将 Java 方法暴露为 AI 工具的核心注解,通常在使用 MCP 协议的框架中(如 Spring AI MCP)使用。以下是关于如何使用 @Tool 注解的详细说明:

1. 注解的基本作用

- 暴露业务能力:通过在 Java 方法上使用

@Tool 注解,可以将该方法注册为一个工具,使得 AI 模型可以在对话中调用这个工具。

- 自动映射:该注解实现了 Java 方法与 MCP 协议工具的自动映射,简化了工具的注册过程。

2. 可选属性

@Tool 注解有两个可选字段:

- name:工具的名称。如果未提供,方法名将作为工具名称。

- value:工具的描述,帮助 AI 模型理解工具的用途。

3. 使用方法

示例代码

以下是一个使用 @Tool 注解的示例代码:

import org.springframework.ai.annotation.Tool;

public class MathService {

/**

* 加法工具

*

* @param a 第一个整数

* @param b 第二个整数

* @return 两个整数的和

*/

@Tool(name = "addTool", value = "一个简单的加法工具")

public int add(int a, int b) {

return a + b;

}

/**

* 乘法工具

*

* @param a 第一个整数

* @param b 第二个整数

* @return 两个整数的乘积

*/

@Tool(name = "multiplyTool", value = "一个简单的乘法工具")

public int multiply(int a, int b) {

return a * b;

}

}

在这个示例中,add 和 multiply 方法都被标记为工具,AI 模型可以通过调用这些工具来执行加法和乘法操作。

4. 注册工具

在使用 @Tool 注解后,需要将这些工具注册到 MCP 服务中,以便 AI 模型能够调用它们。通常,这可以通过定义一个 Spring Bean 来实现:

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

@Configuration

public class ToolConfig {

@Bean

public MathService mathService() {

return new MathService();

}

}

总结

使用 @Tool 注解可以方便地将 Java 方法暴露为 AI 工具,简化了工具的注册和调用过程。通过为工具提供清晰的名称和描述,可以帮助 AI 模型更好地理解和使用这些工具。

Seed-Thinking-v1.5API的具体功能是什么?

如何使用Seed-Thinking-v1.5API进行数据请求?

Seed-Thinking-v1.5API是否支持跨域请求?

Seed-Thinking-v1.5API的具体功能是什么?

如何使用Seed-Thinking-v1.5API进行数据请求?

Seed-Thinking-v1.5API是否支持跨域请求?