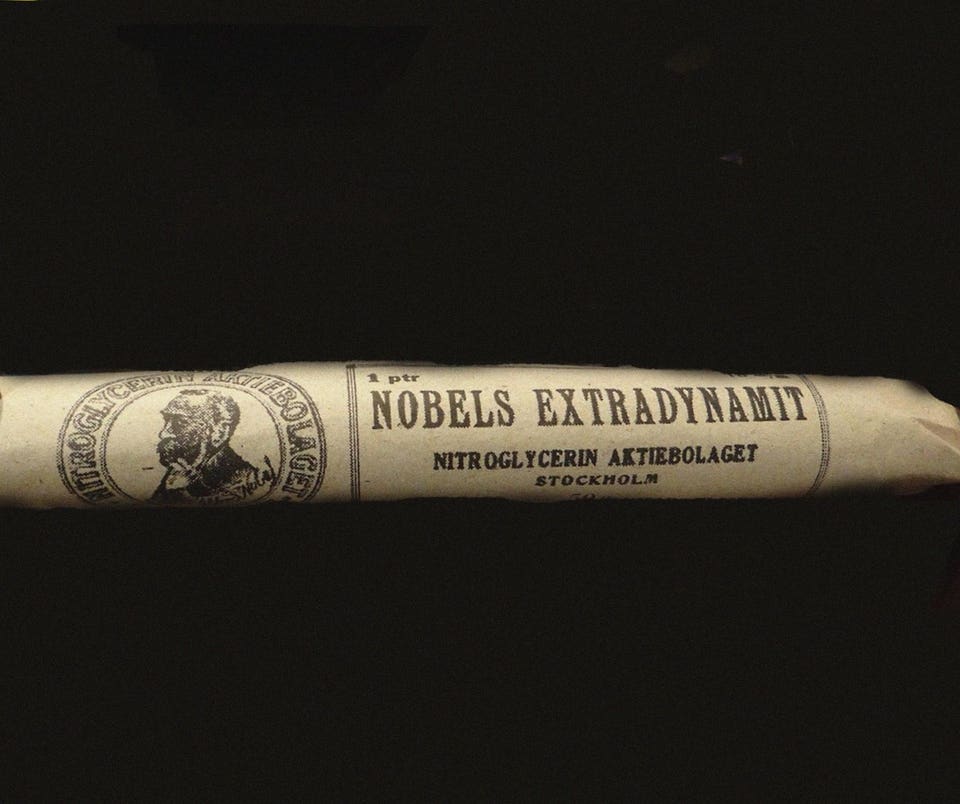

AI的发展正在重复炸药的历史轨迹。这张照片展示了诺贝尔的特制炸药,现藏于斯德哥尔摩诺贝尔博物馆。

AI武器化现状

我们正式进入了网络攻击的新时代。11月,人工智能公司Anthropic和网络安全公司Oligo Security发布的报告揭示,黑客已开始利用突破限制的大语言模型(LLM)实施大规模网络攻击。两家公司证实,攻击者不仅利用LLM生成恶意代码,还在Anthropic的案例中使用了LLM的其他功能来执行攻击行动。

网络安全新挑战

在网络安全领域,LLM已成为网络犯罪分子和国家级威胁行为者的新型攻击工具。这意味着传统时代的防御方法在AI辅助的网络攻击面前将失效。攻击者现在可以通过精心设计的提示,同时实现深度攻击(针对高价值目标)和广度攻击(大规模自动化攻击),而无需持续的人工干预。

在Anthropic报告的案例中,攻击者首先向LLM提供目标信息和攻击框架,并设法突破了Claude系统内置的恶意行为防护机制。随后,攻击活动基本实现自动化执行,导致约30个目标遭受攻击,部分攻击已成功突破防线。

AI防御新思路

应对新形势需要转变防御思维。组织需要摒弃依靠人工操作的传统方式,转而利用AI来应对威胁。这意味着在保障业务正常运营的前提下,优先考虑自动化防御策略。在制定防御方案时,需要综合考虑运营风险和更多的上下文信息,而不是简单地采用"修复/不修复"的二元决策模型。

例如,面对特定业务应用的严重威胁,不应该简单地在整个组织范围内禁用该应用。更好的解决方案是,针对从未使用或近期未使用该应用的用户实施限制,同时为必需使用该应用的用户增加额外的安全控制措施。AI可以提供防御建议并评估实施风险,低风险方案可以自动部署,高风险方案则需要安全工程师介入决策。

尽管攻击者利用AI扩大攻击规模加剧了防御难度,但同样的技术也可以用来平衡战场。采用正确的防御策略,我们有望扭转局势,使之对防御方更为有利。